Sapiens

紹介 :

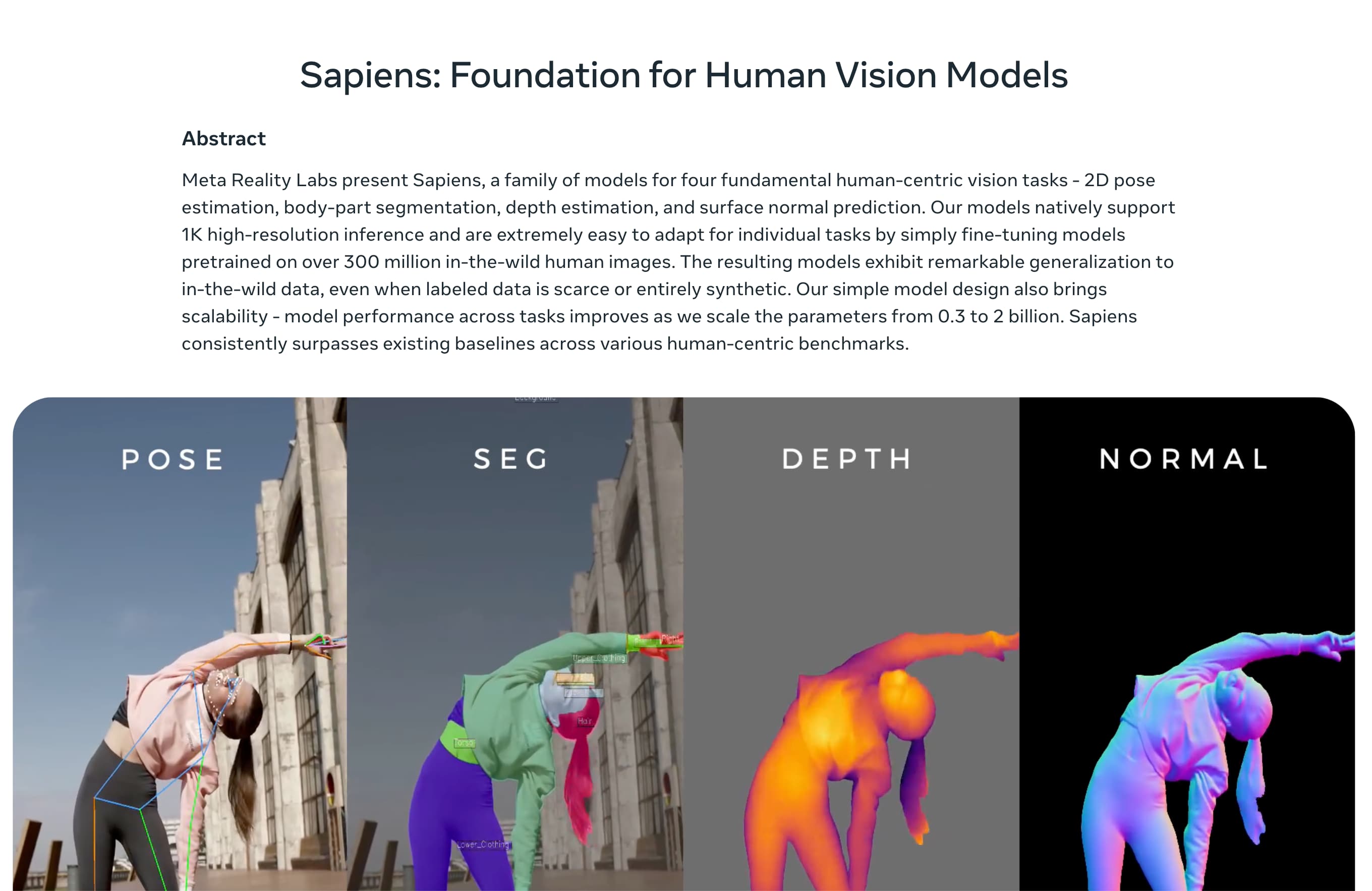

SapiensビジョンモデルはMeta Reality Labsによって開発され、2Dポーズ推定、ボディパーツセグメンテーション、深度推定、サーフェス法線予測など、人間の視覚タスクの処理に特化しています。3億枚を超える人間の画像でトレーニングされており、高解像度画像処理能力を備え、データが不足している状況でも優れたパフォーマンスを発揮します。シンプルで拡張性に優れ、パラメータ増加による性能向上も顕著で、複数のテストにおいて既存の基線モデルを上回っています。

ターゲットユーザー :

Sapiensモデルは、ビデオ監視分析、仮想現実コンテンツ制作、医療リハビリテーション監視、自動運転、ロボットナビゲーションなど、高精度な人体動作と構造分析を必要とする専門家や企業、開発者、研究者に向いています。

使用シナリオ

ビデオ監視システムにおいて、Sapiensモデルは群衆の動作や行動パターンをリアルタイムで分析するために使用できます。

仮想現実アプリケーションにおいて、Sapiensモデルを使用してユーザーの動作を正確にキャプチャおよびシミュレートできます。

医療リハビリテーション分野では、Sapiensモデルを使用して患者の運動回復の進捗状況を監視し、パーソナライズされたリハビリテーションプログラムを提供できます。

製品特徴

2Dポーズ推定:2次元画像内の人体の姿勢を識別?推定します。

ボディパーツセグメンテーション:手、足、頭など、画像内の人体部位を正確に分割します。

深度推定:画像内の物体の深度情報を予測し、3次元空間のレイアウトを理解します。

サーフェス法線予測:物体の表面の方向を推定し、物体の形状と材質を理解します。

高解像度入力処理:高解像度画像を処理し、出力品質を向上させます。

マスク付きオートエンコーダによる事前学習:画像の一部をマスクすることで、ロバストな特徴表現を学習します。

使用チュートリアル

ステップ1:Sapiensモデルを入手し、基本的なアーキテクチャと機能を理解します。

ステップ2:アプリケーションのニーズに合わせて、適切な前処理とデータ拡張方法を選択します。

ステップ3:特定の視覚タスクに合わせてモデルを微調整します。

ステップ4:2Dポーズ推定やボディパーツセグメンテーションなどの実際の視覚タスク処理にモデルを使用します。

ステップ5:モデルの出力結果を分析し、必要に応じてさらなる最適化と調整を行います。

ステップ6:モデルを最終的なアプリケーションまたは研究プロジェクトに統合し、画像分析の自動化を実現します。

おすすめAI製品

Deepmind Gemini

Geminiは、Google DeepMindが開発した次世代人工知能システムです。テキスト、画像、ビデオ、音声、コード間のシームレスな相互作用をサポートし、マルチモーダル推論を実行できます。言語理解、推論、数学、プログラミングなど、複数の分野において従来のシステムを凌駕し、現在までに開発された最も強力なAIシステムの一つとなっています。エッジコンピューティングからクラウドコンピューティングまで、様々なニーズに対応できる3つの異なる規模のバージョンがあります。Geminiは、クリエイティブデザイン、ライティングアシスタント、質問応答、コード生成など、幅広い分野で活用できます。

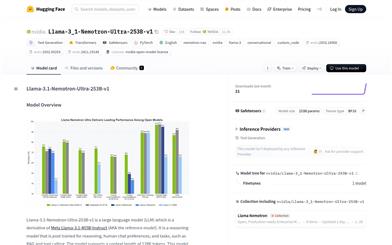

AIモデル

11.4M

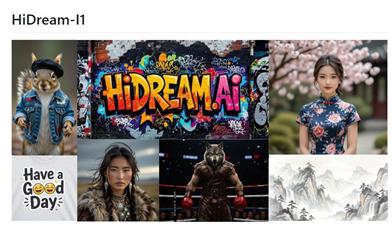

中国語精選

剪映dreamina

剪映DreaminaはTikTok(抖音)が提供するAIGCツールです。テキストを入力すると、AIが自動的にクリエイティブな画像を生成します。画像サイズやアスペクト比、テンプレートの種類も調整可能です。将来的には、TikTokの画像投稿やショート動画のコンテンツ制作にも活用され、TikTokのAIによるコンテンツ制作の充実を図ります。

AI画像生成

9.0M