音声対音声変換

紹介 :

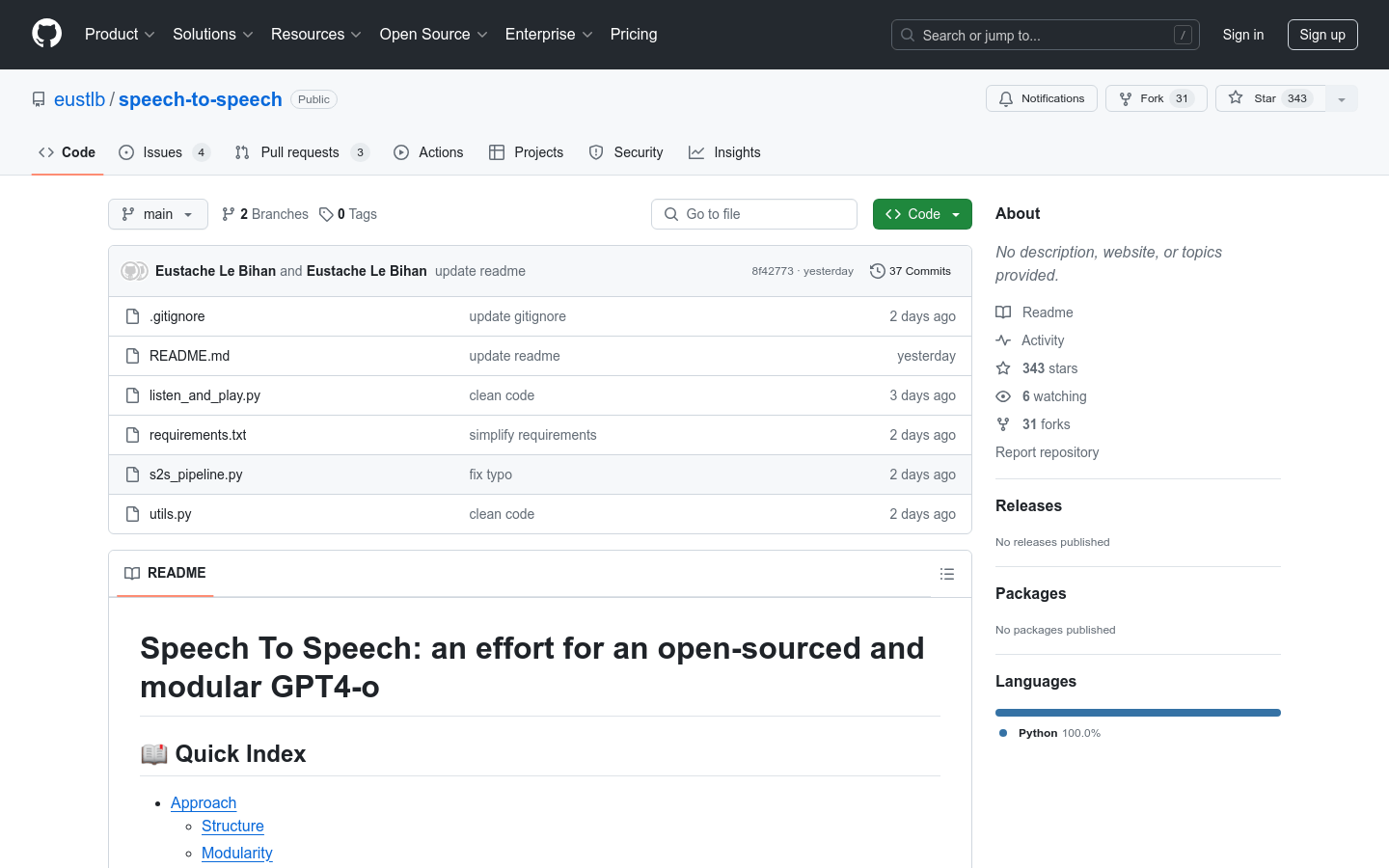

speech-to-speechは、オープンソースのモジュール型GPT4-oプロジェクトです。音声活動検出、音声テキスト変換、言語モデル、テキスト音声変換といった連続したプロセスにより、音声対音声変換を実現します。TransformersライブラリとHugging Face Hubで利用可能なモデルを活用し、高いモジュール性と柔軟性を提供します。

ターゲットユーザー :

開発者や研究者、特に音声認識、自然言語処理、音声合成技術に関心のある方を対象としています。柔軟でカスタマイズ可能なオープンソースツールを提供することで、関連アプリケーションの研究や開発に最適です。

使用シナリオ

開発者はこのモデルを使用して、音声対話機能を持つ音声アシスタントを作成できます。

研究者はこのモデルを使用して、音声認識や音声合成に関する実験や研究を行うことができます。

教育機関は、このモデルを教育ツールに統合し、生徒の音声技術に関する理解を深めることができます。

製品特徴

音声活動検出(VAD):silero VAD v5を使用。

音声テキスト変換(STT):Whisperモデルを使用(蒸留バージョンを含む)。

言語モデル(LM):Hugging Face Hubで利用可能な任意の指示モデルを選択可能。

テキスト音声変換(TTS):Parler-TTSを使用し、様々なチェックポイントに対応。

モジュール設計:各コンポーネントはクラスとして実装され、特定のニーズに合わせて再実装可能。

サーバー/クライアント方式とローカル方式の両方をサポート。

使用チュートリアル

リポジトリをローカル環境にクローンする。

必要な依存関係をインストールする。

必要に応じてモデルパラメータと生成パラメータを設定する。

実行方法を選択する:サーバー/クライアント方式またはローカル方式。

サーバー/クライアント方式の場合は、先にサーバーでモデルを実行し、クライアントで音声入出力処理を行う。

ローカル方式の場合は、ループバックアドレスを使用する。

Torch Compileを使用してWhisperとParler-TTSのパフォーマンスを最適化する。

コマンドラインからモデルを使用し、様々なパラメータを指定して各部分の動作を制御する。

おすすめAI製品

GPT SoVITS

GPT-SoVITS-WebUIは、強力なゼロショット音声変換とテキスト音声変換WebUIです。ゼロショットTTS、少サンプルTTS、クロスリンガルサポート、WebUIツールなどの機能を備えています。英語、日本語、中国語に対応しており、音声伴奏分離、自動トレーニングセット分割、中国語ASR、テキストアノテーションなどの統合ツールを提供し、初心者によるトレーニングデータセットとGPT/SoVITSモデルの作成を支援します。5秒の音声サンプルを入力するだけで、即時のテキスト音声変換を体験できます。また、わずか1分のトレーニングデータでモデルを微調整し、音声の類似度とリアルさを向上させることも可能です。環境準備、PythonとPyTorchのバージョン、クイックインストール、手動インストール、学習済みモデル、データセットフォーマット、TODO、謝辞などをサポートしています。

AI音声合成

5.7M

Clone Voice

Clone-VoiceはWebインターフェースを備えた音声クローンツールです。あらゆる人間のトーンを使用して、テキストをそのトーンで話す音声に合成したり、ある音声のトーンを別のトーンに変換したりできます。中国語、英語、日本語、韓国語、フランス語、ドイツ語、イタリア語など16言語に対応しており、オンラインでマイクから音声を録音できます。テキスト読み上げと音声変換機能を搭載。NカードGPUが不要で、シンプルで使いやすい点が強みです。多言語対応で、音声録音も柔軟に行えます。現在、無料で利用できます。

AI音声合成

3.6M