DCLM

紹介 :

DataComp-LM (DCLM) は、大規模言語モデル(LLM)の構築と訓練を目的とした包括的なフレームワークです。標準化されたコーパス、open_lmフレームワークに基づく効率的な事前学習レシピ、50種類以上の評価方法を提供します。DCLMは、4億1100万パラメータから70億パラメータのモデルまで、様々な計算規模で異なるデータセット構築戦略の実験を研究者が行えるようサポートします。DCLMは、最適化されたデータセット設計によりモデル性能を大幅に向上させ、様々な規模で優れた性能を示し、公開されているすべてのデータセットを凌駕する複数の高品質なデータセットの作成に貢献してきました。

ターゲットユーザー :

DCLMは、大規模言語モデルの構築と訓練を行う研究者や開発者、特に最適化されたデータセット設計によりモデル性能の向上を目指す専門家を対象としています。大規模なデータセットの処理が必要で、異なる計算規模で実験を行いたい場合に適しています。

使用シナリオ

研究者はDCLMを使用してDCLM-BASELINEデータセットを作成し、それを用いてモデルを訓練し、クローズドソースモデルや他のオープンソースデータセットと比較して優れた性能を示しました。

DCLMは、異なる計算ニーズに合わせて、4億パラメータ(400M-1x)や70億パラメータ(7B-2x)など、様々な規模でモデルを訓練できます。

コミュニティメンバーは、DCLMのランキングにモデルを提出することで、異なるデータセットと規模で訓練されたモデルの性能を示しています。

製品特徴

300TBを超える未加工のCommonCrawlコーパスを提供

open_lmフレームワークに基づいた効率的な事前学習レシピを提供

モデル性能を評価するための50種類以上の評価方法を提供

4億1100万パラメータから70億パラメータのモデルまで、様々な計算規模をサポート

研究者が異なるデータセット構築戦略を試行できるようにする

最適化されたデータセット設計によりモデル性能を向上

使用チュートリアル

ローカルにDCLMリポジトリをクローンする

必要な依存関係をインストールする

AWSストレージとRay分散処理環境を設定する

元のデータソースを選択し、参照JSONを作成する

データ処理手順を定義し、pipeline設定ファイルを作成する

Rayクラスタを設定し、データ処理スクリプトを実行する

処理済みデータをトークン化してシャッフルする

トークン化されたデータセットを使用してモデル訓練スクリプトを実行する

訓練されたモデルを評価し、結果をDCLMランキングに提出する

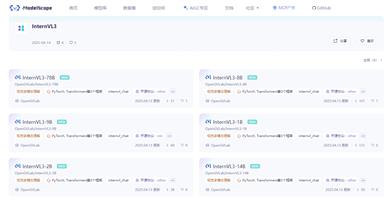

おすすめAI製品

Deepmind Gemini

Geminiは、Google DeepMindが開発した次世代人工知能システムです。テキスト、画像、ビデオ、音声、コード間のシームレスな相互作用をサポートし、マルチモーダル推論を実行できます。言語理解、推論、数学、プログラミングなど、複数の分野において従来のシステムを凌駕し、現在までに開発された最も強力なAIシステムの一つとなっています。エッジコンピューティングからクラウドコンピューティングまで、様々なニーズに対応できる3つの異なる規模のバージョンがあります。Geminiは、クリエイティブデザイン、ライティングアシスタント、質問応答、コード生成など、幅広い分野で活用できます。

AIモデル

11.4M

中国語精選

Liblibai

LiblibAIは、中国をリードするAI創作プラットフォームです。強力なAI創作能力を提供し、クリエイターの創造性を支援します。プラットフォームは膨大な数の無料AI創作モデルを提供しており、ユーザーは検索してモデルを使用し、画像、テキスト、音声などの創作を行うことができます。また、ユーザーによる独自のAIモデルのトレーニングもサポートしています。幅広いクリエイターユーザーを対象としたプラットフォームとして、創作の機会を平等に提供し、クリエイティブ産業に貢献することで、誰もが創作の喜びを享受できるようにすることを目指しています。

AIモデル

6.9M