Fasterliveportrait

紹介 :

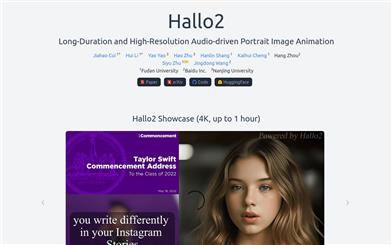

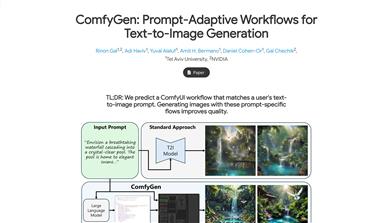

FasterLivePortraitは、深層学習に基づいたリアルタイム肖像動画化プロジェクトです。TensorRTを使用することで、RTX 3090 GPU上で30FPS以上のリアルタイム処理を実現しています(前処理、後処理を含む)。これは、単なるモデル推論速度だけでなく、全体的な処理速度を示しています。本プロジェクトでは、LivePortraitモデルをONNXモデルに変換し、RTX 3090上でonnxruntime-gpuを用いて約70ms/フレームの推論速度を実現しており、クロスプラットフォーム展開をサポートしています。さらに、ネイティブのgradioアプリに対応し、速度が数倍向上し、複数の人物の同時推論も可能です。コード構造は再構築されており、PyTorchへの依存関係は解消され、すべてのモデルはonnxまたはTensorRTを用いて推論を行います。

ターゲットユーザー :

主な対象ユーザーは、深層学習開発者、画像処理研究者、および関連分野の専門家です。リアルタイム環境で肖像のアニメーション処理を行う必要がある方、またはクロスプラットフォーム展開で深層学習モデルを使用する必要がある方に適しています。FasterLivePortraitは、高性能と高い互換性を必要とする開発者にとって、効率的な推論速度と柔軟な展開方法を提供します。

使用シナリオ

ビデオ会議でリアルタイムに動的な肖像を表示する

静止画の肖像写真を動的な動画に変換して、ソーシャルメディアで共有する

ゲームや仮想現実アプリケーションでリアルタイムに動的なキャラクターの肖像を生成する

製品特徴

RTX 3090 GPU上でTensorRTを用いて30FPS以上のリアルタイム処理速度を実現

LivePortraitモデルをONNXモデルに変換し、クロスプラットフォーム展開に対応

ネイティブのgradioアプリに対応し、推論速度を向上させ、複数の人物の同時推論を可能に

コード構造を再構築し、PyTorchへの依存関係を解消、onnxまたはTensorRTを用いた推論を実行

Docker環境に対応し、実行可能なイメージを提供

WindowsとmacOSの統合パッケージに対応し、ワンクリックで実行可能

onnxruntimeとTensorRTの推論に対応し、詳細なインストールと使用方法ガイドを提供

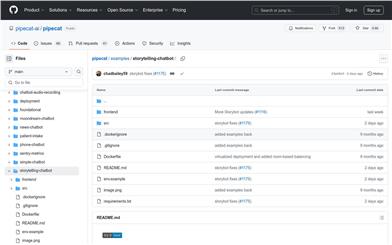

使用チュートリアル

1. Dockerをインストールし、FasterLivePortraitのDockerイメージをダウンロードする

2. Dockerコマンドを使用してFasterLivePortraitコンテナを実行する

3. ONNXモデルファイルをダウンロードして変換し、チェックポイントフォルダに配置する

4. onnxruntime-gpuまたはTensorRTをインストールして設定する

5. 提供されているスクリプトを使用してONNXモデルをTensorRTモデルに変換する

6. app.pyを実行してgradioアプリを起動し、onnxまたはtensorrtモードを選択する

7. ローカルサーバー(デフォルトポート9870)にアクセスし、アプリを使用してリアルタイム肖像アニメーションを行う

おすすめAI製品

中国語精選

剪映dreamina

剪映DreaminaはTikTok(抖音)が提供するAIGCツールです。テキストを入力すると、AIが自動的にクリエイティブな画像を生成します。画像サイズやアスペクト比、テンプレートの種類も調整可能です。将来的には、TikTokの画像投稿やショート動画のコンテンツ制作にも活用され、TikTokのAIによるコンテンツ制作の充実を図ります。

AI画像生成

9.0M

Motionshop

Motionshopは、AIを活用したキャラクターアニメーションを作成できるウェブサイトです。アップロードした動画から人物を自動検出し、3Dのカートゥーンキャラクターモデルに置き換えることで、面白いAI動画を生成します。シンプルで使いやすいインターフェースと強力なAIアルゴリズムにより、ユーザーは簡単に自身の動画コンテンツを生動感あふれるアニメーション作品に変換できます。

AI動画編集

5.9M