EVE

紹介 :

EVEは、大連理工大学、北京人工智能研究院、北京大学の研究者によって共同開発された、エンコーダフリーの視覚言語モデルです。様々なアスペクト比の画像において優れた能力を発揮し、Fuyu-8Bを上回り、モジュール型エンコーダベースのLVLMsに匹敵する性能を示します。EVEはデータ効率とトレーニング効率に優れ、33Mの公開データを用いた事前学習と、665KのLLaVA SFTデータを用いたEVE-7Bモデルのトレーニング、さらに1.2MのSFTデータを用いたEVE-7B (HD)モデルのトレーニングが行われています。EVEの開発は、効率的で透明性が高く、実用的な戦略を採用しており、クロスモーダルな純粋なデコーダアーキテクチャに新たな道を切り開いています。

ターゲットユーザー :

EVEモデルは、主に人工知能分野の研究者や開発者、特に視覚言語タスクや自然言語処理に特化した専門家を対象としています。その高いデータ処理能力とトレーニング効率により、大規模な視覚データや言語モデルの処理が必要な場面に最適であり、人工知能分野の発展に大きく貢献します。

使用シナリオ

研究者がEVEモデルを用いて画像キャプション生成タスクを実行する。

開発者がEVEを用いて視覚的質問応答システムを開発する。

教育機関がEVEモデルを用いて視覚言語モデルの構築と応用を教える。

製品特徴

任意のアスペクト比を持つ画像に対応した視覚言語モデル設計。

少量の公開データを用いた効率的な事前学習。

大量のSFTデータを用いた更なる最適化。

トレーニング効率において、2台の8-A100 (40G)ノードを用いて約9日間でトレーニング完了。

エンコーダフリーアーキテクチャにより、モデルの複雑さを簡素化し、透明性を向上。

複数の視覚言語タスクにおいて優れた性能を発揮。

使用チュートリアル

EVEのGitHubページにアクセスして、プロジェクト情報とコードを取得します。

READMEファイルを読んで、モデルのインストールと設定要件を確認します。

指示に従って、必要な依存関係をダウンロードしてインストールします。

EVEモデルのコードリポジトリをローカル環境にクローンまたはダウンロードします。

ドキュメントの手順に従って、モデルのトレーニングまたはテストを実行します。

必要に応じて、モデルパラメータを調整して、様々な視覚言語タスクに対応させます。

コミュニティフォーラムに参加して、ヘルプを受けたり、コードに貢献したりします。

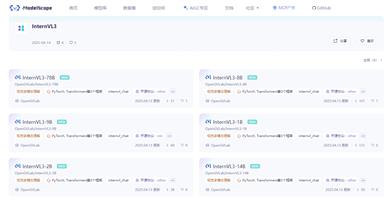

おすすめAI製品

Deepmind Gemini

Geminiは、Google DeepMindが開発した次世代人工知能システムです。テキスト、画像、ビデオ、音声、コード間のシームレスな相互作用をサポートし、マルチモーダル推論を実行できます。言語理解、推論、数学、プログラミングなど、複数の分野において従来のシステムを凌駕し、現在までに開発された最も強力なAIシステムの一つとなっています。エッジコンピューティングからクラウドコンピューティングまで、様々なニーズに対応できる3つの異なる規模のバージョンがあります。Geminiは、クリエイティブデザイン、ライティングアシスタント、質問応答、コード生成など、幅広い分野で活用できます。

AIモデル

11.4M

中国語精選

剪映dreamina

剪映DreaminaはTikTok(抖音)が提供するAIGCツールです。テキストを入力すると、AIが自動的にクリエイティブな画像を生成します。画像サイズやアスペクト比、テンプレートの種類も調整可能です。将来的には、TikTokの画像投稿やショート動画のコンテンツ制作にも活用され、TikTokのAIによるコンテンツ制作の充実を図ります。

AI画像生成

9.0M