SD3 ControlNet Canny

紹介 :

SD3-ControlNet-Cannyは、深層学習に基づいた画像生成モデルであり、ユーザーが提供するテキストプロンプトに基づいて、特定のスタイルを持つ画像を生成できます。コントロールネット技術を利用することで、生成画像の詳細やスタイルをより正確に制御し、画像生成の品質と多様性を向上させます。

ターゲットユーザー :

主な対象ユーザーは、画像生成分野の研究者や開発者、そしてAIアート創作に興味のあるアーティストやデザイナーです。このモデルは、彼らが高品質な画像作品を迅速に生成し、創作効率を向上させるのに役立ちます。

使用シナリオ

アニメスタイルのキャラクターイラストを生成します。

月と嵐の背景など、特定のシーンの背景を持つ画像を作成します。

テキストの追加など、特定の要素を持つ画像をカスタマイズして生成します。

製品特徴

テキストプロンプトに基づいて特定のスタイルの画像を生成します。

コントロールネット技術を使用して画像の詳細を正確に制御します。

ガイダンススケールや画像サイズなどの様々な画像生成パラメータに対応しています。

GPU上で動作し、生成効率を向上させます。

事前学習済みモデルを提供しており、ユーザーはすぐに使用を開始できます。

生成結果に影響を与えるために、カスタムコントロール画像をサポートしています。

使用チュートリアル

1. Diffusers-SD3-ControlNetなど、必要なライブラリと依存関係をインストールします。

2. 事前学習済みモデルとコントロールネットの設定を読み込みます。

3. 画像生成の方向性を指示するために、テキストプロンプトとネガティブプロンプトを定義します。

4. コントロールウェイトやコントロール画像など、コントロールネットの具体的なパラメータを設定します。

5. 画像生成プロセスを実行し、生成ステップ数とガイダンススケールを調整します。

6. 生成された画像を取得し、必要に応じて後処理または表示を行います。

おすすめAI製品

Deepmind Gemini

Geminiは、Google DeepMindが開発した次世代人工知能システムです。テキスト、画像、ビデオ、音声、コード間のシームレスな相互作用をサポートし、マルチモーダル推論を実行できます。言語理解、推論、数学、プログラミングなど、複数の分野において従来のシステムを凌駕し、現在までに開発された最も強力なAIシステムの一つとなっています。エッジコンピューティングからクラウドコンピューティングまで、様々なニーズに対応できる3つの異なる規模のバージョンがあります。Geminiは、クリエイティブデザイン、ライティングアシスタント、質問応答、コード生成など、幅広い分野で活用できます。

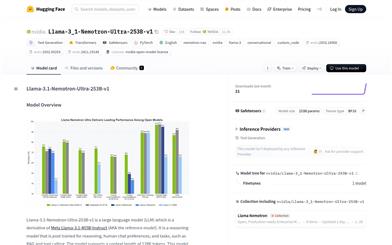

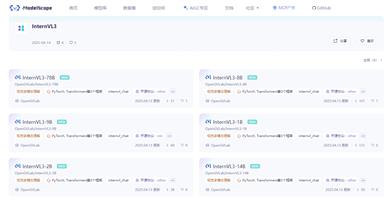

AIモデル

11.4M

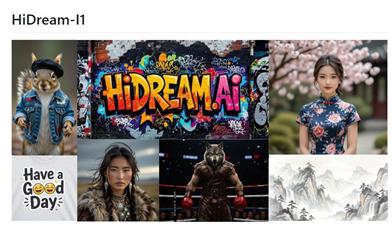

中国語精選

剪映dreamina

剪映DreaminaはTikTok(抖音)が提供するAIGCツールです。テキストを入力すると、AIが自動的にクリエイティブな画像を生成します。画像サイズやアスペクト比、テンプレートの種類も調整可能です。将来的には、TikTokの画像投稿やショート動画のコンテンツ制作にも活用され、TikTokのAIによるコンテンツ制作の充実を図ります。

AI画像生成

9.0M