Mistral Finetune

紹介 :

mistral-finetuneは、LoRAトレーニングパラダイムに基づいた軽量コードライブラリです。大部分の重みを凍結したまま、追加の重みの1~2%のみを、低ランク行列摂動の形でファインチューニングできます。多GPU単一ノードのトレーニング設定に最適化されており、7Bモデルのような比較的小さいモデルであれば、単一のGPUでも十分です。このコードライブラリは、特にデータフォーマットに関して、シンプルで分かりやすいファインチューニングの入り口を提供することを目的としており、多様なモデルアーキテクチャやハードウェアタイプを網羅することを目的としていません。

ターゲットユーザー :

「大規模言語モデルをファインチューニングする必要がある研究者や開発者を対象としています。この製品は、特にリソースが限られている場合や特定の機能のカスタマイズが必要なシナリオにおいて、軽量で効率的なファインチューニングソリューションを提供するため、最適です。」

使用シナリオ

研究者はmistral-finetuneを使用して7Bモデルをファインチューニングし、特定の対話システムに適応させました。

開発者はこのライブラリを利用して、チャットボットに新しい機能を追加し、モデルをファインチューニングすることでユーザーの問い合わせを理解できるようにしました。

教育機関はmistral-finetuneを使用して、生徒が提出した論文の自動採点をし、採点効率を向上させました。

製品特徴

LoRAベースのトレーニングパラダイムをサポートし、モデルのごく一部の重みのみをトレーニングします。

最大限の効率を得るには、A100またはH100 GPUの使用をお勧めします。

コードライブラリは、多GPU単一ノードのトレーニング構成に最適化されています。

依存関係のインストール、モデルのダウンロード、データの準備など、詳細なインストールと使用方法のガイドを提供します。

厳格なトレーニングデータのフォーマット要件があり、jsonl形式のデータファイルをサポートします。

対話データと指示追従データのトレーニングをサポートします。

データの検証とフォーマットツールを提供し、データの正確性を保証します。

使用チュートリアル

コードライブラリをローカル環境にクローンします。

必要な依存関係をすべてインストールします。

必要なMistralモデルをダウンロードして準備します。

ガイドに従ってトレーニングデータセットを準備し、データ形式が正しいことを確認します。

提供されているツールを使用してデータセットを検証およびフォーマットします。

設定ファイルを変更し、モデルパス、データパス、その他のトレーニングパラメータを指定します。

トレーニングプロセスを開始し、トレーニングの進捗状況とパフォーマンスを監視します。

トレーニングが完了したら、mistral-inferenceを使用してモデル推論テストを実行します。

おすすめAI製品

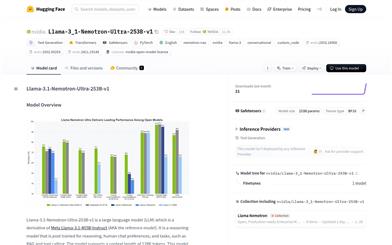

Deepmind Gemini

Geminiは、Google DeepMindが開発した次世代人工知能システムです。テキスト、画像、ビデオ、音声、コード間のシームレスな相互作用をサポートし、マルチモーダル推論を実行できます。言語理解、推論、数学、プログラミングなど、複数の分野において従来のシステムを凌駕し、現在までに開発された最も強力なAIシステムの一つとなっています。エッジコンピューティングからクラウドコンピューティングまで、様々なニーズに対応できる3つの異なる規模のバージョンがあります。Geminiは、クリエイティブデザイン、ライティングアシスタント、質問応答、コード生成など、幅広い分野で活用できます。

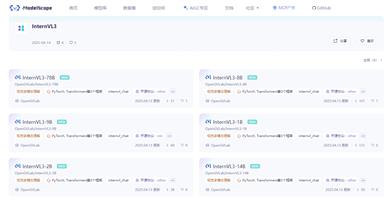

AIモデル

11.4M

中国語精選

Liblibai

LiblibAIは、中国をリードするAI創作プラットフォームです。強力なAI創作能力を提供し、クリエイターの創造性を支援します。プラットフォームは膨大な数の無料AI創作モデルを提供しており、ユーザーは検索してモデルを使用し、画像、テキスト、音声などの創作を行うことができます。また、ユーザーによる独自のAIモデルのトレーニングもサポートしています。幅広いクリエイターユーザーを対象としたプラットフォームとして、創作の機会を平等に提供し、クリエイティブ産業に貢献することで、誰もが創作の喜びを享受できるようにすることを目指しています。

AIモデル

6.9M