Coreweave GPU 云计算

CoreWeave GPU 云计算是一个专为人工智能工作负载打造的云平台,提供灵活且高效的 GPU 集群,能够满足企业在大规模计算和存储方面的需求。它的主要优势包括极高的性能、可靠性和可扩展性,适合各种 AI 应用场景。通过 CoreWeave,用户能够显著降低云成本,同时提升服务响应速度,是 AI 创新的理想选择。

GPU

63.8K

Bytedance Flux

Flux 是由字节跳动开发的一个高性能通信重叠库,专为 GPU 上的张量和专家并行设计。它通过高效的内核和对 PyTorch 的兼容性,支持多种并行化策略,适用于大规模模型训练和推理。Flux 的主要优点包括高性能、易于集成和对多种 NVIDIA GPU 架构的支持。它在大规模分布式训练中表现出色,尤其是在 Mixture-of-Experts (MoE) 模型中,能够显著提高计算效率。

模型训练与部署

75.3K

3FS

3FS是一个专为AI训练和推理工作负载设计的高性能分布式文件系统。它利用现代SSD和RDMA网络,提供共享存储层,简化分布式应用开发。其核心优势在于高性能、强一致性和对多种工作负载的支持,能够显著提升AI开发和部署的效率。该系统适用于大规模AI项目,尤其在数据准备、训练和推理阶段表现出色。

开发与工具

52.2K

优质新品

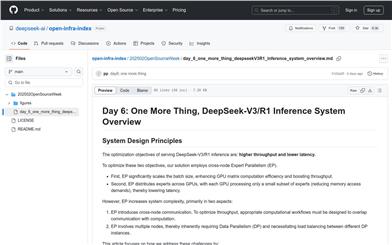

Deepseek V3/R1 推理系统

DeepSeek-V3/R1 推理系统是 DeepSeek 团队开发的高性能推理架构,旨在优化大规模稀疏模型的推理效率。它通过跨节点专家并行(EP)技术,显著提升 GPU 矩阵计算效率,降低延迟。该系统采用双批量重叠策略和多级负载均衡机制,确保在大规模分布式环境中高效运行。其主要优点包括高吞吐量、低延迟和优化的资源利用率,适用于高性能计算和 AI 推理场景。

模型训练与部署

51.1K

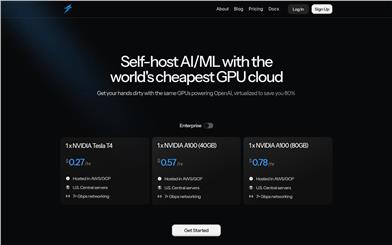

Thunder Compute

Thunder Compute是一个专注于AI/ML开发的GPU云服务平台,通过虚拟化技术,帮助用户以极低的成本使用高性能GPU资源。其主要优点是价格低廉,相比传统云服务提供商可节省高达80%的成本。该平台支持多种主流GPU型号,如NVIDIA Tesla T4、A100等,并提供7+ Gbps的网络连接,确保数据传输的高效性。Thunder Compute的目标是为AI开发者和企业降低硬件成本,加速模型训练和部署,推动AI技术的普及和应用。

开发平台

51.3K

Evo 2

Evo 2 是由 NVIDIA 推出的 AI 基础模型,旨在通过深度学习技术解析生物分子的遗传密码。该模型基于 NVIDIA DGX Cloud 平台开发,能够处理大规模的基因组数据,为生物医学研究提供强大的工具。Evo 2 的主要优点在于其能够处理长达 100 万个 token 的基因序列,从而更全面地理解基因组的复杂性。该模型在生物医学领域的应用前景广阔,包括疾病诊断、药物开发和基因编辑等。Evo 2 的开发得到了 Arc 研究所和斯坦福大学的支持,目标是推动生物医学研究的创新和突破。

AI模型

54.9K

优质新品

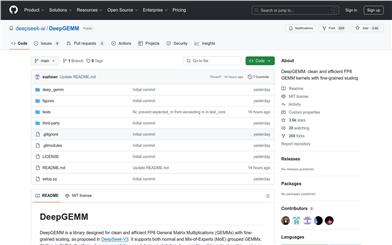

Deepgemm

DeepGEMM是一个专注于高效FP8矩阵乘法的CUDA库。它通过细粒度缩放和多种优化技术,如Hopper TMA特性、持久化线程专业化、全JIT设计等,显著提升了矩阵运算的性能。该库主要面向深度学习和高性能计算领域,适用于需要高效矩阵运算的场景。它支持NVIDIA Hopper架构的Tensor Core,并且在多种矩阵形状下展现出卓越的性能。DeepGEMM的设计简洁,核心代码仅约300行,易于学习和使用,同时性能与专家优化的库相当或更好。开源免费的特性使其成为研究人员和开发者进行深度学习优化和开发的理想选择。

开发与工具

54.1K

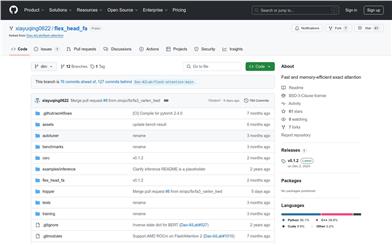

Flexheadfa

FlexHeadFA 是一个基于 FlashAttention 的改进模型,专注于提供快速且内存高效的精确注意力机制。它支持灵活的头维度配置,能够显著提升大语言模型的性能和效率。该模型的主要优点包括高效利用 GPU 资源、支持多种头维度配置以及与 FlashAttention-2 和 FlashAttention-3 兼容。它适用于需要高效计算和内存优化的深度学习场景,尤其在处理长序列数据时表现出色。

模型训练与部署

51.6K

优质新品

NVIDIA Project DIGITS

NVIDIA Project DIGITS 是一款基于 NVIDIA GB10 Grace Blackwell 超级芯片的桌面超级计算机,旨在为 AI 开发者提供强大的 AI 性能。它能够在功耗高效、紧凑的形态中提供每秒一千万亿次的 AI 性能。该产品预装了 NVIDIA AI 软件栈,并配备了 128GB 的内存,使开发者能够在本地原型设计、微调和推理高达 2000 亿参数的大型 AI 模型,并无缝部署到数据中心或云中。Project DIGITS 的推出标志着 NVIDIA 在推动 AI 开发和创新方面的又一重要里程碑,为开发者提供了一个强大的工具,以加速 AI 模型的开发和部署。

开发平台

66.0K

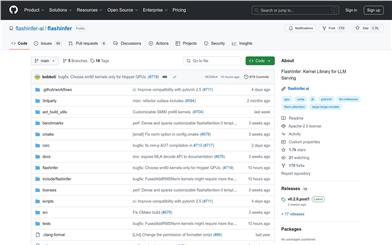

Flashinfer

FlashInfer是一个专为大型语言模型(LLM)服务而设计的高性能GPU内核库。它通过提供高效的稀疏/密集注意力机制、负载平衡调度、内存效率优化等功能,显著提升了LLM在推理和部署时的性能。FlashInfer支持PyTorch、TVM和C++ API,易于集成到现有项目中。其主要优点包括高效的内核实现、灵活的自定义能力和广泛的兼容性。FlashInfer的开发背景是为了满足日益增长的LLM应用需求,提供更高效、更可靠的推理支持。

开发与工具

62.9K

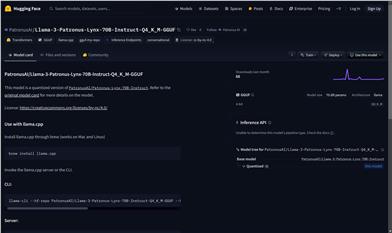

Llama 3 Patronus Lynx 70B Instruct Q4 K M GGUF

PatronusAI/Llama-3-Patronus-Lynx-70B-Instruct-Q4_K_M-GGUF是一个基于70B参数的大型量化语言模型,使用了4-bit量化技术,以减少模型大小并提高推理效率。该模型属于PatronusAI系列,是基于Transformers库构建的,适用于需要高性能自然语言处理的应用场景。模型遵循cc-by-nc-4.0许可协议,意味着可以非商业性地使用和分享。

AI模型

48.6K

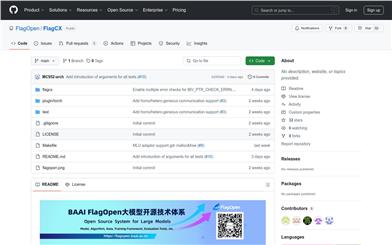

Flagcx

FlagCX是由北京人工智能研究院(BAAI)支持开发的可扩展和自适应的跨芯片通信库。它是FlagAI-Open开源计划的一部分,旨在促进AI技术的开源生态系统。FlagCX利用原生集体通信库,全面支持不同平台上的单芯片通信。支持的通信后端包括NCCL、IXCCL和CNCL。

开发与工具

55.5K

EXAONE 3.5 32B Instruct AWQ

EXAONE-3.5-32B-Instruct-AWQ是LG AI Research开发的一系列指令调优的双语(英语和韩语)生成模型,参数从2.4B到32B不等。这些模型支持长达32K令牌的长上下文处理,在真实世界用例和长上下文理解方面展现出最先进的性能,同时在与最近发布的类似大小模型相比,在通用领域保持竞争力。该模型通过AWQ量化技术,实现了4位组级别的权重量化,优化了模型的部署效率。

AI模型

52.7K

中文精选

Deepseek V3

DeepSeek-V3是一个强大的Mixture-of-Experts (MoE) 语言模型,拥有671B的总参数量,每次激活37B参数。它采用了Multi-head Latent Attention (MLA) 和 DeepSeekMoE架构,这些架构在DeepSeek-V2中得到了充分的验证。此外,DeepSeek-V3首次采用了无辅助损失的负载均衡策略,并设置了多令牌预测训练目标,以实现更强大的性能。DeepSeek-V3在14.8万亿高质量令牌上进行了预训练,随后进行了监督式微调和强化学习阶段,以充分利用其能力。综合评估显示,DeepSeek-V3超越了其他开源模型,并达到了与领先的闭源模型相当的性能。尽管性能出色,DeepSeek-V3的完整训练仅需要2.788M H800 GPU小时,并且训练过程非常稳定。

AI模型

736.9K

Fastvideo

FastVideo是一个开源框架,旨在加速大型视频扩散模型。它提供了FastHunyuan和FastMochi两种一致性蒸馏视频扩散模型,实现了8倍推理速度提升。FastVideo基于PCM(Phased-Consistency-Model)提供了首个开放的视频DiT蒸馏配方,支持对最先进的开放视频DiT模型进行蒸馏、微调和推理,包括Mochi和Hunyuan。此外,FastVideo还支持使用FSDP、序列并行和选择性激活检查点进行可扩展训练,以及使用LoRA、预计算潜在和预计算文本嵌入进行内存高效微调。FastVideo的开发正在进行中,技术高度实验性,未来计划包括增加更多蒸馏方法、支持更多模型以及代码更新。

视频生成

64.6K

Trillium TPU

Trillium TPU是Google Cloud的第六代Tensor Processing Unit(TPU),专为AI工作负载设计,提供增强的性能和成本效益。它作为Google Cloud AI Hypercomputer的关键组件,通过集成的硬件系统、开放软件、领先的机器学习框架和灵活的消费模型,支持大规模AI模型的训练、微调和推理。Trillium TPU在性能、成本效率和可持续性方面都有显著提升,是AI领域的重要进步。

模型训练与部署

51.6K

Deepseek V2.5 1210

DeepSeek-V2.5-1210是DeepSeek-V2.5的升级版本,它在多个能力方面进行了改进,包括数学、编码和写作推理。模型在MATH-500基准测试中的性能从74.8%提高到82.8%,在LiveCodebench (08.01 - 12.01)基准测试中的准确率从29.2%提高到34.38%。此外,新版本优化了文件上传和网页摘要功能的用户体验。DeepSeek-V2系列(包括基础和聊天)支持商业用途。

代码助手

70.1K

Rain AI

Rain AI专注于开发高能效的人工智能硬件。在当前能源消耗日益增长的背景下,Rain AI的产品通过优化硬件设计,减少能源消耗,同时保持高性能,这对于数据中心和需要大量计算资源的企业来说至关重要。产品的主要优点包括高能效、高性能和环保。Rain AI的产品背景信息显示,公司致力于推动人工智能技术的可持续发展,通过技术创新减少对环境的影响。产品的价格和定位尚未明确,但可以推测其目标市场为需要高性能计算且对能源效率有高要求的企业。

硬件

45.0K

Falcon Mamba 7b

tiiuae/falcon-mamba-7b是由TII UAE开发的高性能因果语言模型,基于Mamba架构,专为生成任务设计。该模型在多个基准测试中展现出色的表现,并且能够在不同的硬件配置上运行,支持多种精度设置,以适应不同的性能和资源需求。模型的训练使用了先进的3D并行策略和ZeRO优化技术,使其在大规模GPU集群上高效训练成为可能。

AI模型

43.6K

AMD Instinct MI325X Accelerators

AMD Instinct MI325X加速器基于AMD CDNA 3架构,专为AI任务设计,包括基础模型训练、微调和推理,提供卓越的性能和效率。这些产品使AMD的客户和合作伙伴能够在系统、机架和数据中心层面创建高性能和优化的AI解决方案。AMD Instinct MI325X加速器提供了行业领先的内存容量和带宽,支持6.0TB/s的256GB HBM3E,比H200多1.8倍的容量和1.3倍的带宽,提供了更高的FP16和FP8计算性能。

AI模型

45.0K

Intel Gaudi 3 AI Accelerator

Intel® Gaudi® 3 AI Accelerator是英特尔推出的一款高性能人工智能加速器,它基于高效的英特尔® Gaudi® 平台构建,具备出色的MLPerf基准性能,旨在处理要求苛刻的训练和推理任务。该加速器支持数据中心或云中的大型语言模型、多模态模型和企业RAG等人工智能应用程序,能够在您可能已经拥有的以太网基础设施上运行。无论您需要单个加速器还是数千个加速器,英特尔Gaudi 3都可以在您的AI成功中发挥关键作用。

AI模型推理训练

48.6K

Sifive

SiFive是RISC-V架构的领导者,提供高性能、高效率的计算解决方案,适用于汽车、AI、数据中心等应用。其产品以优越的性能和效率,以及全球社区的支持,推动了RISC-V技术的发展和应用。

开发与工具

49.4K

Groq

Groq是一家提供高性能AI芯片和云服务的公司,专注于为AI模型提供超低延迟的推理服务。其产品GroqCloud™自2024年2月推出以来,已经有超过467,000名开发者使用。Groq的AI芯片技术由Meta的首席AI科学家Yann LeCun提供技术支持,并且获得了BlackRock领投的6.4亿美元融资,公司估值达到28亿美元。Groq的技术优势在于其能够无缝地从其他提供商迁移到Groq,仅需更改三行代码,并且与OpenAI的端点兼容。Groq的AI芯片旨在挑战Nvidia在AI芯片市场的领导地位,为开发者和企业提供更快、更高效的AI推理解决方案。

开发与工具

272.7K

Qwen2.5 LLM

Qwen2.5系列语言模型是一系列开源的decoder-only稠密模型,参数规模从0.5B到72B不等,旨在满足不同产品对模型规模的需求。这些模型在自然语言理解、代码生成、数学推理等多个领域表现出色,特别适合需要高性能语言处理能力的应用场景。Qwen2.5系列模型的发布,标志着在大型语言模型领域的一次重要进步,为开发者和研究者提供了强大的工具。

AI模型

49.7K

优质新品

Azure Quantum

Azure Quantum 是微软推出的量子计算平台,旨在通过先进的量子计算技术加速科学研究和材料科学领域的发现。它通过结合人工智能、高性能计算和量子计算,提供了一套完整的工具和资源,以帮助研究人员和开发者在量子领域取得突破。Azure Quantum 的愿景是将250年的科学进步加速到未来25年,通过量子超级计算机解决人类面临的最困难问题。

AI开发助手

46.4K

国外精选

Cerebras Inference

Cerebras Inference是Cerebras公司推出的AI推理平台,提供20倍于GPU的速度和1/5的成本。它利用Cerebras的高性能计算技术,为大规模语言模型、高性能计算等提供快速、高效的推理服务。该平台支持多种AI模型,包括医疗、能源、政府和金融服务等行业应用,具有开放源代码的特性,允许用户训练自己的基础模型或微调开源模型。

模型训练与部署

56.6K

国外精选

Graphcore

Graphcore是一家专注于人工智能硬件加速器的公司,其产品主要面向需要高性能计算的人工智能领域。Graphcore的IPU(智能处理单元)技术为机器学习、深度学习等AI应用提供了强大的计算支持。公司的产品包括云端IPU、数据中心IPU以及Bow IPU处理器等,这些产品通过Poplar® Software进行优化,能够显著提升AI模型的训练和推理速度。Graphcore的产品和技术在金融、生物技术、科研等多个行业都有应用,帮助企业和研究机构加速AI项目的实验过程,提高效率。

AI模型

51.3K

Skywork MoE Base FP8

Skywork-MoE是一个具有146亿参数的高性能混合专家(MoE)模型,拥有16个专家和22亿激活参数。该模型从Skywork-13B模型的密集型检查点初始化而来。引入了两种创新技术:门控逻辑归一化,增强专家多样化;自适应辅助损失系数,允许层特定的辅助损失系数调整。Skywork-MoE在各种流行基准测试中,如C-Eval、MMLU、CMMLU、GSM8K、MATH和HumanEval,展现出与参数更多或激活参数更多的模型相当的或更优越的性能。

AI模型

46.6K

Crusoe Cloud

Crusoe提供可扩展的、气候对齐的数字基础设施,专为高性能计算和人工智能优化。我们的创新方法通过使用浪费的、孤立的或清洁能源来减少温室气体排放,支持能源转型,并最大化资源效率。

AI模型

60.4K

国外精选

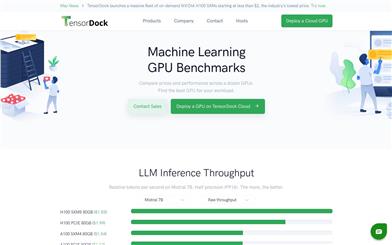

Tensordock

TensorDock 是一个为需要无可妥协可靠性的工作负载而构建的专业云服务提供商。它提供多种 GPU 服务器选项,包括 NVIDIA H100 SXMs,以及针对深度学习、AI 和渲染的最具成本效益的虚拟机基础设施。TensorDock 还提供全托管容器托管服务,具备操作系统级监控、自动扩展和负载均衡功能。此外,TensorDock 提供世界级别的企业支持,由专业人员提供服务。

开发与工具

58.0K

- 1

- 2

精选AI产品推荐

中文精选

Nocode

NoCode 是一款无需编程经验的平台,允许用户通过自然语言描述创意并快速生成应用,旨在降低开发门槛,让更多人能实现他们的创意。该平台提供实时预览和一键部署功能,非常适合非技术背景的用户,帮助他们将想法转化为现实。

开发平台

97.2K

优质新品

Listenhub

ListenHub 是一款轻量级的 AI 播客生成工具,支持中文和英语,基于前沿 AI 技术,能够快速生成用户感兴趣的播客内容。其主要优点包括自然对话和超真实人声效果,使得用户能够随时随地享受高品质的听觉体验。ListenHub 不仅提升了内容生成的速度,还兼容移动端,便于用户在不同场合使用。产品定位为高效的信息获取工具,适合广泛的听众需求。

音频生成

81.1K

国外精选

Lovart

Lovart 是一款革命性的 AI 设计代理,能够将创意提示转化为艺术作品,支持从故事板到品牌视觉的多种设计需求。其重要性在于打破传统设计流程,节省时间并提升创意灵感。Lovart 当前处于测试阶段,用户可加入等候名单,随时体验设计的乐趣。

AI设计工具

100.7K

Fastvlm

FastVLM 是一种高效的视觉编码模型,专为视觉语言模型设计。它通过创新的 FastViTHD 混合视觉编码器,减少了高分辨率图像的编码时间和输出的 token 数量,使得模型在速度和精度上表现出色。FastVLM 的主要定位是为开发者提供强大的视觉语言处理能力,适用于各种应用场景,尤其在需要快速响应的移动设备上表现优异。

AI模型

83.4K

国外精选

Smart PDFs

Smart PDFs 是一个在线工具,利用 AI 技术快速分析 PDF 文档,并生成简明扼要的总结。它适合需要快速获取文档要点的用户,如学生、研究人员和商务人士。该工具使用 Llama 3.3 模型,支持多种语言,是提高工作效率的理想选择,完全免费使用。

文章摘要

51.3K

Keysync

KeySync 是一个针对高分辨率视频的无泄漏唇同步框架。它解决了传统唇同步技术中的时间一致性问题,同时通过巧妙的遮罩策略处理表情泄漏和面部遮挡。KeySync 的优越性体现在其在唇重建和跨同步方面的先进成果,适用于自动配音等实际应用场景。

视频编辑

78.9K

Anyvoice

AnyVoice是一款领先的AI声音生成器,采用先进的深度学习模型,将文本转换为与人类无法区分的自然语音。其主要优点包括超真实的声音效果、多语言支持、快速生成能力以及语音定制功能。该产品适用于多种场景,如内容创作、教育、商业和娱乐制作等,旨在为用户提供高效、便捷的语音生成解决方案。目前产品提供免费试用,适合不同层次的用户。

音频生成

651.1K

中文精选

Liblibai

LiblibAI是一个中国领先的AI创作平台,提供强大的AI创作能力,帮助创作者实现创意。平台提供海量免费AI创作模型,用户可以搜索使用模型进行图像、文字、音频等创作。平台还支持用户训练自己的AI模型。平台定位于广大创作者用户,致力于创造条件普惠,服务创意产业,让每个人都享有创作的乐趣。

AI模型

8.0M