EXAONE 3.5 7.8B Instruct AWQ

简介 :

EXAONE 3.5是LG AI Research开发的一系列指令调优的双语(英语和韩语)生成模型,参数范围从2.4B到32B。这些模型支持长达32K令牌的长上下文处理,并在真实世界用例和长上下文理解方面展现出最先进的性能,同时在与最近发布的类似大小模型相比的一般领域中保持竞争力。EXAONE 3.5模型包括:1) 2.4B模型,优化用于小型或资源受限设备的部署;2) 7.8B模型,与前代模型大小相匹配,但提供改进的性能;3) 32B模型,提供强大的性能。

需求人群 :

目标受众为需要进行长上下文处理和双语文本生成的开发者和研究人员。EXAONE-3.5-7.8B-Instruct-AWQ模型因其先进的性能和长上下文理解能力,特别适合需要处理大量数据和多语言内容的复杂任务,如机器翻译、文本摘要、对话系统等。

使用场景

使用EXAONE-3.5-7.8B-Instruct-AWQ模型进行长文本的机器翻译。

利用模型进行多轮对话系统的开发,以提供更加自然和流畅的对话体验。

在处理大量文本数据时,使用模型进行文本摘要和关键信息提取。

产品特色

支持长上下文处理,最多32K令牌。

在真实世界用例和长上下文理解方面展现出最先进的性能。

与最近发布的类似大小模型相比,在一般领域中保持竞争力。

支持双语(英语和韩语)生成。

提供AWQ量化权重,实现4位组内权重量化(W4A16g128)。

支持多种部署框架,如TensorRT-LLM、vLLM、SGLang等。

提供预量化的EXAONE 3.5模型,以GGUF格式提供。

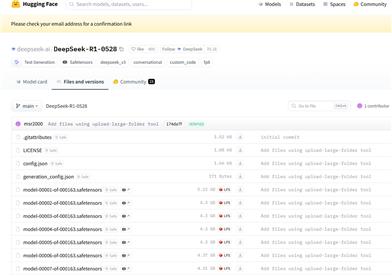

使用教程

1. 安装必要的库,如transformers和autoawq。

2. 从Hugging Face加载EXAONE-3.5-7.8B-Instruct-AWQ模型和分词器。

3. 准备输入文本,可以是英文或韩文。

4. 使用分词器对输入文本进行编码。

5. 将编码后的输入传递给模型进行生成。

6. 根据需要调整模型参数,如最大新令牌数、是否采样等。

7. 输出生成的文本,并使用分词器进行解码。

8. 分析和利用生成的文本进行进一步的应用开发。

精选AI产品推荐

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系统。它能够进行多模态推理,支持文本、图像、视频、音频和代码之间的无缝交互。Gemini在语言理解、推理、数学、编程等多个领域都超越了之前的状态,成为迄今为止最强大的AI系统之一。它有三个不同规模的版本,可满足从边缘计算到云计算的各种需求。Gemini可以广泛应用于创意设计、写作辅助、问题解答、代码生成等领域。

AI模型

11.4M

中文精选

Liblibai

LiblibAI是一个中国领先的AI创作平台,提供强大的AI创作能力,帮助创作者实现创意。平台提供海量免费AI创作模型,用户可以搜索使用模型进行图像、文字、音频等创作。平台还支持用户训练自己的AI模型。平台定位于广大创作者用户,致力于创造条件普惠,服务创意产业,让每个人都享有创作的乐趣。

AI模型

8.0M