Llava OneVision

简介 :

LLaVA-OneVision是一款由字节跳动公司与多所大学合作开发的多模态大型模型(LMMs),它在单图像、多图像和视频场景中推动了开放大型多模态模型的性能边界。该模型的设计允许在不同模态/场景之间进行强大的迁移学习,展现出新的综合能力,特别是在视频理解和跨场景能力方面,通过图像到视频的任务转换进行了演示。

需求人群 :

LLaVA-OneVision的目标受众是计算机视觉领域的研究人员和开发者,以及需要处理和分析大量视觉数据的企业。它适合那些寻求通过高级视觉识别和理解技术来提高产品或服务智能化水平的用户。

使用场景

研究人员使用LLaVA-OneVision模型来提高自动驾驶车辆对周围环境的理解能力。

开发者利用该模型在社交媒体平台上自动标记和描述用户上传的视频内容。

企业采用LLaVA-OneVision来自动化分析监控视频中的异常行为,提高安全监控的效率。

产品特色

提供详细的视频内容中突出主题的描述

在图像和视频中识别相同的个体并理解其关系

将图表和表格理解能力迁移到多图像场景中,以连贯的方式解释多张图像

作为代理角色,识别iPhone上的多个屏幕截图并与之交互,提供自动化任务的操作指令

展示优秀的标记提示能力,根据图像中的数字标签描述具体对象,突出其处理细粒度视觉内容的理解技能

基于静态图像生成详细的视频创作提示,将此能力从图像到图像的语言编辑生成中推广到视频

分析具有相同起始帧但不同结尾的视频之间的差异

分析具有相似背景但不同前景对象的视频之间的差异

在自动驾驶环境中分析和解释多摄像机视频素材

理解并详细描述组合子视频

使用教程

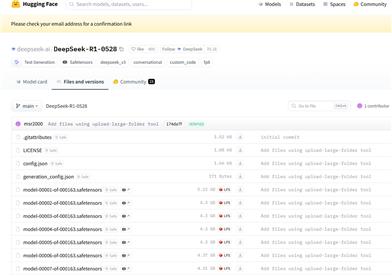

访问LLaVA-OneVision的开源页面,了解模型的基本信息和使用条件。

下载训练代码和预训练模型检查点,根据需要选择合适的模型规模。

探索训练数据集,了解模型在单图像和OneVision阶段的训练情况。

尝试在线演示,亲自体验模型的功能和效果。

根据具体应用场景,调整模型参数,进行定制化的训练和优化。

精选AI产品推荐

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系统。它能够进行多模态推理,支持文本、图像、视频、音频和代码之间的无缝交互。Gemini在语言理解、推理、数学、编程等多个领域都超越了之前的状态,成为迄今为止最强大的AI系统之一。它有三个不同规模的版本,可满足从边缘计算到云计算的各种需求。Gemini可以广泛应用于创意设计、写作辅助、问题解答、代码生成等领域。

AI模型

11.4M

中文精选

剪映dreamina

剪映Dreamina是抖音旗下的AIGC工具,用户可以根据文本内容生成由AI生成的创意图,支持修整图片大小比例和模板类型。未来会用于抖音的图文或短视频的内容创作,丰富抖音在AI创造方面的内容库。

AI图像生成

9.1M