LSLM

简介 :

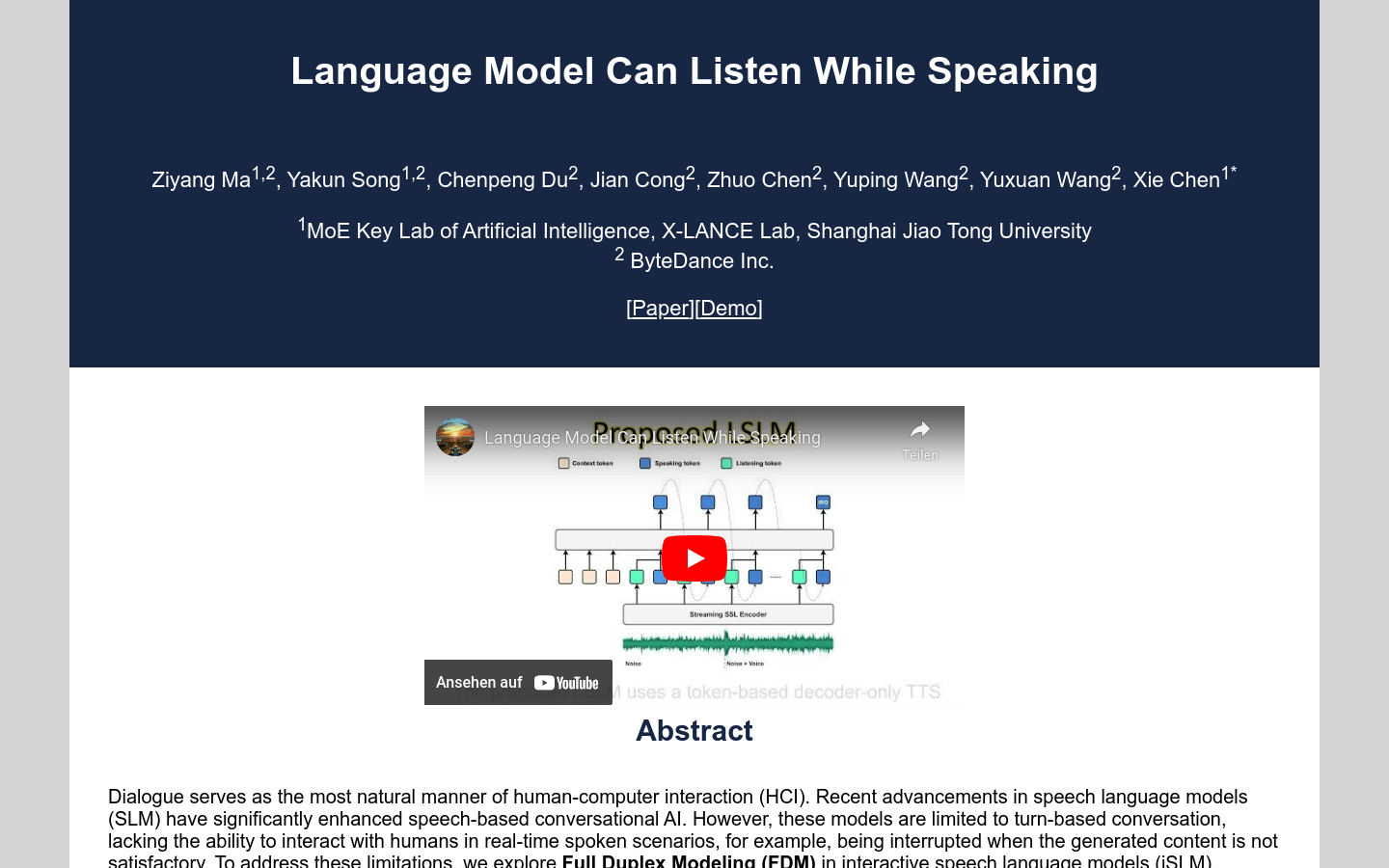

Listening-while-Speaking Language Model (LSLM)是一款旨在提升人机交互自然度的人工智能对话模型。它通过全双工建模(FDM)技术,实现了在说话时同时监听的能力,增强了实时交互性,尤其是在生成内容不满意时能够被打断和实时响应。LSLM采用了基于token的解码器仅TTS进行语音生成,以及流式自监督学习(SSL)编码器进行实时音频输入,通过三种融合策略(早期融合、中期融合和晚期融合)探索最佳交互平衡。

需求人群 :

LSLM主要面向需要高级人机交互的企业和开发者,特别是那些希望提升其对话系统自然度和实时响应能力的公司。例如,智能助手、客服机器人和虚拟个人助理等领域。

使用场景

智能助手在用户提问时能即时回应并根据用户反馈调整回答。

客服机器人在处理客户咨询时能够实时打断和更正信息。

虚拟个人助理在执行任务时能够边说边听,以更自然的方式与用户交流。

产品特色

支持全双工对话,即在说话时也能监听。

使用基于token的解码器仅TTS技术生成语音。

采用流式自监督学习(SSL)编码器处理实时音频输入。

通过早期融合、中期融合和晚期融合策略优化交互。

在命令式和语音式FDM场景下测试模型的双工通信能力。

对现有系统影响最小,易于集成到现有对话系统中。

使用教程

步骤1: 集成LSLM模型到现有的对话系统中。

步骤2: 配置模型参数,包括融合策略和交互设置。

步骤3: 训练模型以适应特定的对话场景和用户指令。

步骤4: 测试模型在不同噪声条件下的双工通信能力。

步骤5: 根据测试结果调整模型参数,优化交互体验。

步骤6: 将优化后的模型部署到生产环境中,开始实时交互。