Figure AI Helix

Helix 是一款創新的視覺-語言-行動模型,專為人形機器人的通用控制而設計。它通過將視覺感知、語言理解和動作控制相結合,解決了機器人在複雜環境中的多項長期挑戰。Helix 的主要優點包括強大的泛化能力、高效的數據利用以及無需任務特定微調的單一神經網絡架構。該模型旨在為家庭環境中的機器人提供即時行為生成能力,使其能夠處理從未見過的物品。Helix 的出現標誌著機器人技術在適應日常生活場景方面邁出了重要一步。

智能體

47.7K

Paligemma2 3b Pt 224

PaliGemma 2是由Google開發的視覺-語言模型,它結合了SigLIP視覺模型和Gemma 2語言模型的能力,能夠處理圖像和文本輸入,並生成相應的文本輸出。該模型在多種視覺-語言任務上表現出色,如圖像描述、視覺問答等。其主要優點包括強大的多語言支持、高效的訓練架構以及在多種任務上的優異性能。PaliGemma 2的開發背景是為了解決視覺和語言之間的複雜交互問題,幫助研究人員和開發者在相關領域取得突破。

AI模型

46.9K

Paligemma2 3b Pt 448

PaliGemma 2是一個由Google開發的視覺-語言模型,繼承了Gemma 2模型的能力,能夠處理圖像和文本輸入並生成文本輸出。該模型在多種視覺語言任務上表現出色,如圖像描述、視覺問答等。其主要優點包括強大的多語言支持、高效的訓練架構和廣泛的適用性。該模型適用於需要處理視覺和文本數據的各種應用場景,如社交媒體內容生成、智能客服等。

AI模型

46.9K

ROCKET 1

ROCKET-1是一個視覺-語言模型(VLMs),專門針對開放世界環境中的具身決策制定而設計。該模型通過視覺-時間上下文提示協議,將VLMs與策略模型之間的通信連接起來,利用來自過去和當前觀察的對象分割來指導策略-環境交互。ROCKET-1通過這種方式,能夠解鎖VLMs的視覺-語言推理能力,使其能夠解決複雜的創造性任務,尤其是在空間理解方面。ROCKET-1在Minecraft中的實驗表明,該方法使代理能夠完成以前無法實現的任務,突出了視覺-時間上下文提示在具身決策制定中的有效性。

模型訓練與部署

48.6K

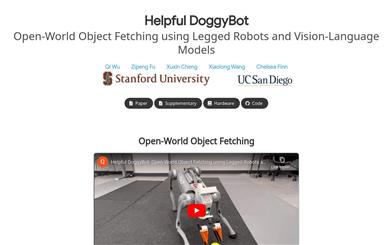

Helpful DoggyBot

Helpful DoggyBot是一個四足機器人室內移動操作系統,它通過前端夾持裝置進行物體操作,使用在模擬環境中訓練的低級控制器實現敏捷技能,如攀爬和全身傾斜。此外,它還結合了預訓練的視覺-語言模型(VLMs)進行語義理解和命令生成。該系統在沒有實際數據收集或訓練的情況下,能在未見過的環境中零樣本泛化完成任務,如按照用戶的指令在攀爬過後的床邊取回隨機放置的玩具,成功率達到60%。

AI機器人

45.3K

Florence 2 Base Ft

Florence-2是由微軟開發的高級視覺基礎模型,採用基於提示的方法處理廣泛的視覺和視覺-語言任務。該模型能夠解釋簡單的文本提示,執行諸如圖像描述、目標檢測和分割等任務。它利用FLD-5B數據集,包含54億個註釋,覆蓋1.26億張圖像,精通多任務學習。其序列到序列的架構使其在零樣本和微調設置中均表現出色,證明是一個有競爭力的視覺基礎模型。

AI圖像生成

65.1K

Pixelprose

PixelProse是一個由tomg-group-umd創建的大規模數據集,它利用先進的視覺-語言模型Gemini 1.0 Pro Vision生成了超過1600萬個詳細的圖像描述。這個數據集對於開發和改進圖像到文本的轉換技術具有重要意義,可以用於圖像描述生成、視覺問答等任務。

AI圖像檢測識別

54.9K

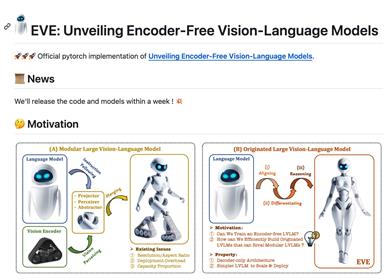

EVE

EVE是一個編碼器自由的視覺-語言模型,由大連理工大學、北京人工智能研究院和北京大學的研究人員共同開發。它在不同圖像寬高比下展現出卓越的能力,性能超越了Fuyu-8B,並且接近模塊化編碼器基礎的LVLMs。EVE在數據效率、訓練效率方面表現突出,使用33M公開數據進行預訓練,並利用665K LLaVA SFT數據為EVE-7B模型訓練,以及額外的1.2M SFT數據為EVE-7B (HD)模型訓練。EVE的開發採用了高效、透明、實用的策略,為跨模態的純解碼器架構開闢了新途徑。

AI模型

48.9K

RL4VLM

RL4VLM是一個開源項目,旨在通過強化學習微調大型視覺-語言模型,使其成為能夠做出決策的智能代理。該項目由Yuexiang Zhai, Hao Bai, Zipeng Lin, Jiayi Pan, Shengbang Tong, Alane Suhr, Saining Xie, Yann LeCun, Yi Ma, Sergey Levine等研究人員共同開發。它基於LLaVA模型,並採用了PPO算法進行強化學習微調。RL4VLM項目提供了詳細的代碼庫結構、入門指南、許可證信息以及如何引用該研究的說明。

AI模型

56.9K

精選AI產品推薦

中文精選

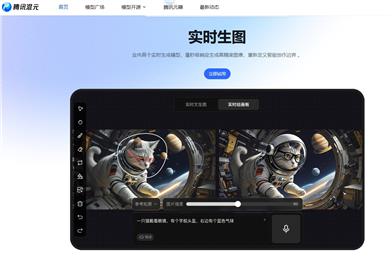

騰訊混元圖像 2.0

騰訊混元圖像 2.0 是騰訊最新發布的 AI 圖像生成模型,顯著提升了生成速度和畫質。通過超高壓縮倍率的編解碼器和全新擴散架構,使得圖像生成速度可達到毫秒級,避免了傳統生成的等待時間。同時,模型通過強化學習算法與人類美學知識的結合,提升了圖像的真實感和細節表現,適合設計師、創作者等專業用戶使用。

圖片生成

80.9K

國外精選

Lovart

Lovart 是一款革命性的 AI 設計代理,能夠將創意提示轉化為藝術作品,支持從故事板到品牌視覺的多種設計需求。其重要性在於打破傳統設計流程,節省時間並提升創意靈感。Lovart 當前處於測試階段,用戶可加入等候名單,隨時體驗設計的樂趣。

AI設計工具

64.0K

Fastvlm

FastVLM 是一種高效的視覺編碼模型,專為視覺語言模型設計。它通過創新的 FastViTHD 混合視覺編碼器,減少了高分辨率圖像的編碼時間和輸出的 token 數量,使得模型在速度和精度上表現出色。FastVLM 的主要定位是為開發者提供強大的視覺語言處理能力,適用於各種應用場景,尤其在需要快速響應的移動設備上表現優異。

AI模型

51.1K

Keysync

KeySync 是一個針對高分辨率視頻的無洩漏唇同步框架。它解決了傳統唇同步技術中的時間一致性問題,同時通過巧妙的遮罩策略處理表情洩漏和麵部遮擋。KeySync 的優越性體現在其在唇重建和跨同步方面的先進成果,適用於自動配音等實際應用場景。

視頻編輯

48.6K

Manus

Manus 是由 Monica.im 研發的全球首款真正自主的 AI 代理產品,能夠直接交付完整的任務成果,而不僅僅是提供建議或答案。它採用 Multiple Agent 架構,運行在獨立虛擬機中,能夠通過編寫和執行代碼、瀏覽網頁、操作應用等方式直接完成任務。Manus 在 GAIA 基準測試中取得了 SOTA 表現,展現了強大的任務執行能力。其目標是成為用戶在數字世界的‘代理人’,幫助用戶高效完成各種複雜任務。

個人助理

1.5M

Trae國內版

Trae是一款專為中文開發場景設計的AI原生IDE,將AI技術深度集成於開發環境中。它通過智能代碼補全、上下文理解等功能,顯著提升開發效率和代碼質量。Trae的出現填補了國內AI集成開發工具的空白,滿足了中文開發者對高效開發工具的需求。其定位為高端開發工具,旨在為專業開發者提供強大的技術支持,目前尚未明確公開價格,但預計會採用付費模式以匹配其高端定位。

開發與工具

138.0K

國外精選

Pika

Pika是一個視頻製作平臺,用戶可以上傳自己的創意想法,Pika會自動生成相關的視頻。主要功能有:支持多種創意想法轉視頻,視頻效果專業,操作簡單易用。平臺採用免費試用模式,定位面向創意者和視頻愛好者。

視頻生成

18.7M

中文精選

Liblibai

LiblibAI是一箇中國領先的AI創作平臺,提供強大的AI創作能力,幫助創作者實現創意。平臺提供海量免費AI創作模型,用戶可以搜索使用模型進行圖像、文字、音頻等創作。平臺還支持用戶訓練自己的AI模型。平臺定位於廣大創作者用戶,致力於創造條件普惠,服務創意產業,讓每個人都享有創作的樂趣。

AI模型

8.0M