Llama Lynx 70b 4bitAWQ

簡介 :

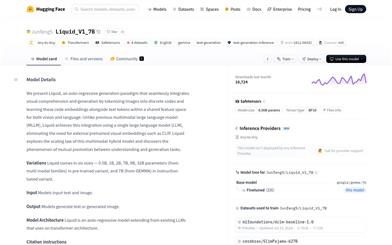

Llama-lynx-70b-4bitAWQ是一個由Hugging Face託管的70億參數的文本生成模型,使用了4-bit精度和AWQ技術。該模型在自然語言處理領域具有重要性,特別是在需要處理大量數據和複雜任務時。它的優勢在於能夠生成高質量的文本,同時保持較低的計算成本。產品背景信息顯示,該模型與'transformers'和'safetensors'庫兼容,適用於文本生成任務。

需求人群 :

目標受眾為自然語言處理領域的研究人員、開發者和企業用戶。他們需要一個能夠處理大規模文本數據並生成高質量文本輸出的模型。Llama-lynx-70b-4bitAWQ因其高效的計算性能和生成能力,特別適合需要進行文本分析、內容創作和自動化對話系統開發的用戶。

使用場景

案例1: 使用Llama-lynx-70b-4bitAWQ生成文章摘要,提高內容生產的效率。

案例2: 集成到聊天機器人中,提供流暢自然的對話體驗。

案例3: 應用於教育領域,自動生成教學材料和課程內容。

產品特色

• 文本生成:能夠根據給定的輸入生成連貫、相關的文本。

• 4-bit精度:模型使用4-bit精度,減少了模型大小,同時保持性能。

• AWQ技術:應用了AWQ技術,優化了模型的推理效率。

• 兼容性:與'transformers'和'safetensors'庫兼容,易於集成到現有的NLP工作流中。

• 多語言支持:雖然頁面未明確說明,但模型可能支持多種語言的文本生成。

• 端點兼容:模型可以部署到Hugging Face的Inference Endpoints,便於在線推理。

• 社區支持:Hugging Face社區提供了討論和反饋的平臺,有助於模型的持續改進。

使用教程

1. 註冊並登錄Hugging Face賬戶。

2. 訪問Llama-lynx-70b-4bitAWQ模型頁面。

3. 查看模型文檔,瞭解如何在你的項目中集成和使用模型。

4. 使用Hugging Face提供的代碼示例開始文本生成任務。

5. 根據需要調整輸入參數,以生成特定類型的文本。

6. 利用模型的多語言能力,探索不同語言的文本生成效果。

7. 部署模型到Inference Endpoints,實現在線文本生成服務。

8. 參與社區討論,反饋使用體驗,共同推動模型的優化和升級。

精選AI產品推薦

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系統。它能夠進行多模態推理,支持文本、圖像、視頻、音頻和代碼之間的無縫交互。Gemini在語言理解、推理、數學、編程等多個領域都超越了之前的狀態,成為迄今為止最強大的AI系統之一。它有三個不同規模的版本,可滿足從邊緣計算到雲計算的各種需求。Gemini可以廣泛應用於創意設計、寫作輔助、問題解答、代碼生成等領域。

AI模型

11.4M

優質新品

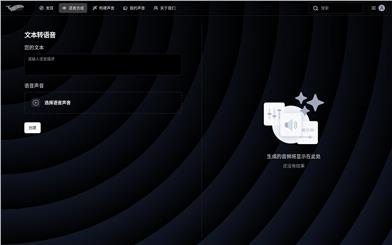

Fish Audio文本轉語音

文本轉語音技術是一種將文本信息轉換為語音的技術,廣泛應用於輔助閱讀、語音助手、有聲讀物製作等領域。它通過模擬人類語音,提高了信息獲取的便捷性,尤其對視力障礙者或在無法使用眼睛閱讀的情況下非常有幫助。

文本轉聲音

10.1M