使用場景

研究人員使用該模型評估不同對話系統中的助手回答。

開發者利用模型評分來優化他們的聊天機器人的對話質量。

教育機構使用該模型來評估和提高教學助手的交互質量。

產品特色

評估助手回答的五個屬性:有用性、正確性、連貫性、複雜性和冗餘性。

可以作為傳統獎勵模型輸出單一標量。

使用HelpSteer2數據集進行訓練,提高模型性能。

與NVIDIA NeMo-Aligner兼容,支持數據和模型並行訓練。

所有檢查點與NeMo生態系統兼容,支持推理部署和進一步定製。

在RewardBench Primary Dataset LeaderBoard上表現優異。

使用教程

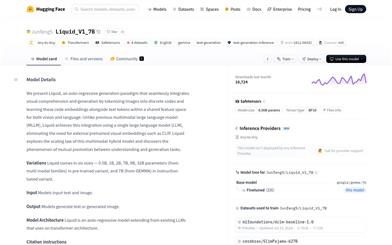

1. 從NVIDIA的Hugging Face頁面下載Llama3-70B-SteerLM-RM模型。

2. 根據SteerLM訓練用戶指南使用NeMo Aligner啟動推理服務器。

3. 使用推理服務器對數據文件進行標註。

4. 根據SteerLM訓練用戶指南訓練SteerLM模型。

5. 使用標註的數據文件訓練模型以提高其評估能力。

6. 將訓練好的模型部署到實際應用中,進行語言模型輸出的評估和優化。

精選AI產品推薦

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系統。它能夠進行多模態推理,支持文本、圖像、視頻、音頻和代碼之間的無縫交互。Gemini在語言理解、推理、數學、編程等多個領域都超越了之前的狀態,成為迄今為止最強大的AI系統之一。它有三個不同規模的版本,可滿足從邊緣計算到雲計算的各種需求。Gemini可以廣泛應用於創意設計、寫作輔助、問題解答、代碼生成等領域。

AI模型

11.4M

中文精選

Liblibai

LiblibAI是一箇中國領先的AI創作平臺,提供強大的AI創作能力,幫助創作者實現創意。平臺提供海量免費AI創作模型,用戶可以搜索使用模型進行圖像、文字、音頻等創作。平臺還支持用戶訓練自己的AI模型。平臺定位於廣大創作者用戶,致力於創造條件普惠,服務創意產業,讓每個人都享有創作的樂趣。

AI模型

8.0M