使用場景

講述關於探索火星的奇妙旅程給5歲孩子聽

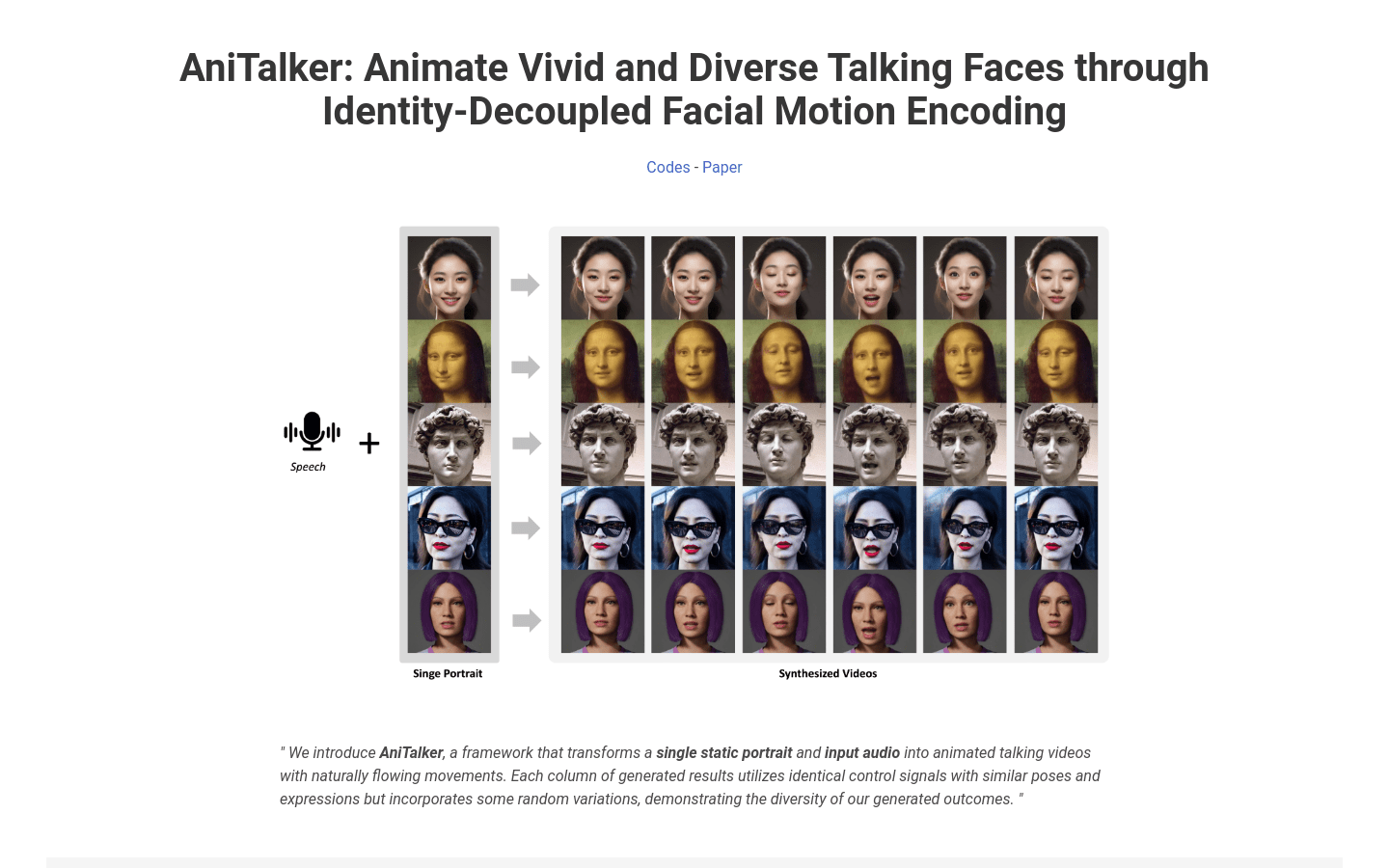

以蒙娜麗莎的身份講述現代生活的想法

比較不同音頻驅動和視頻驅動方法下的產品效果

產品特色

從單一肖像生成逼真的對話面部動畫

通過自監督學習策略捕捉面部動態

使用度量學習開發身份編碼器

最小化身份和運動編碼器之間的互信息

生成多樣化和可控的面部動畫

減少對標記數據的依賴

適用於現實世界應用,如動態頭像製作

使用教程

1. 訪問AniTalker的網頁

2. 選擇一個靜態肖像作為輸入

3. 提供一段輸入音頻

4. 選擇所需的動畫效果和風格

5. 啟動動畫生成過程

6. 等待AniTalker處理並生成動畫視頻

7. 下載或分享生成的動畫視頻

精選AI產品推薦

Sora

Sora是一個基於大規模訓練的文本控制視頻生成擴散模型。它能夠生成長達1分鐘的高清視頻,涵蓋廣泛的視覺數據類型和分辨率。Sora通過在視頻和圖像的壓縮潛在空間中訓練,將其分解為時空位置補丁,實現了可擴展的視頻生成。Sora還展現出一些模擬物理世界和數字世界的能力,如三維一致性和交互,揭示了繼續擴大視頻生成模型規模來發展高能力模擬器的前景。

AI視頻生成

17.2M

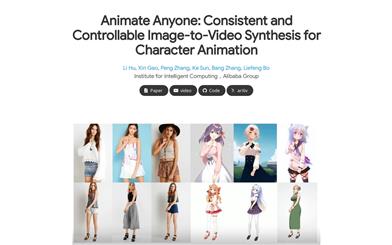

Animate Anyone

Animate Anyone旨在通過驅動信號從靜態圖像生成角色視頻。我們利用擴散模型的力量,提出了一個專為角色動畫量身定製的新框架。為了保持參考圖像中複雜外觀特徵的一致性,我們設計了ReferenceNet來通過空間注意力合併詳細特徵。為了確保可控性和連續性,我們引入了一個高效的姿勢指導器來指導角色的動作,並採用了一種有效的時間建模方法,以確保視頻幀之間的平滑跨幀過渡。通過擴展訓練數據,我們的方法可以為任意角色製作動畫,與其他圖像到視頻方法相比,在角色動畫方面取得了出色的結果。此外,我們在時尚視頻和人類舞蹈合成的基準上評估了我們的方法,取得了最先進的結果。

AI視頻生成

11.8M