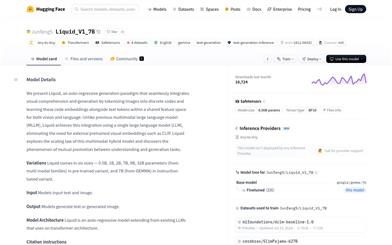

AIM

簡介 :

這篇論文介紹了AIM,這是一組使用自迴歸目標進行預訓練的視覺模型。這些模型受其文本對應物,即大型語言模型(LLMs)的啟發,並表現出類似的擴展特性。具體來說,我們強調了兩個關鍵發現:(1)視覺特徵的性能隨著模型容量和數據量的增加而提高,(2)目標函數的價值與模型在下游任務上的性能相關。我們通過在20億張圖像上對70億參數的AIM進行預訓練,實現了在ImageNet-1k上使用凍結主幹達到84.0%的準確率。有趣的是,即使在這個規模上,我們觀察到性能沒有飽和的跡象,這表明AIM可能代表了訓練大規模視覺模型的新前沿。AIM的預訓練類似於LLMs的預訓練,並不需要任何圖像特定的策略來穩定大規模訓練。

需求人群 :

適用於大規模圖像數據的自迴歸預訓練,以及需要訓練大規模視覺模型的場景。

使用場景

用於自動駕駛系統中的大規模圖像識別

在醫學影像分析中的大規模數據預訓練

應用於智能監控系統的大規模視覺模型訓練

產品特色

自迴歸圖像模型預訓練

大規模視覺模型訓練

性能優化和擴展

精選AI產品推薦

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系統。它能夠進行多模態推理,支持文本、圖像、視頻、音頻和代碼之間的無縫交互。Gemini在語言理解、推理、數學、編程等多個領域都超越了之前的狀態,成為迄今為止最強大的AI系統之一。它有三個不同規模的版本,可滿足從邊緣計算到雲計算的各種需求。Gemini可以廣泛應用於創意設計、寫作輔助、問題解答、代碼生成等領域。

AI模型

11.4M

中文精選

剪映dreamina

剪映Dreamina是抖音旗下的AIGC工具,用戶可以根據文本內容生成由AI生成的創意圖,支持修整圖片大小比例和模板類型。未來會用於抖音的圖文或短視頻的內容創作,豐富抖音在AI創造方面的內容庫。

AI圖像生成

9.1M