Animate Anyone 2

Animate Anyone 2は、拡散モデルに基づいたキャラクター画像アニメーション技術であり、環境に高度に適合したアニメーションを生成できます。環境表現を条件入力として抽出することにより、従来の方法ではキャラクターと環境の関連性が不足していた問題を解決しています。この技術の主な利点としては、高忠実度、環境適合性の高さ、そして優れた動きの処理能力が挙げられます。映画制作、ゲーム開発など、高品質なアニメーション生成が必要なシーンに適しており、クリエイターは環境とのインタラクションを持つキャラクターアニメーションを迅速に生成し、時間とコストを節約できます。

AI設計ツール

64.9K

Gaussianspeech

GaussianSpeechは、音声信号から高忠実度のアニメーションシーケンスを合成し、リアルで個性的な3Dアバターを作成できる革新的な手法です。音声信号と3Dガウス描画技術を組み合わせることで、皮膚のしわや細かい表情筋の動きなど、人間の頭部の表情や細かい動作を捉えます。GaussianSpeechの主な利点としては、リアルタイムレンダリング速度、自然な視覚的ダイナミクス、そして多様な表情やスタイルの表現が挙げられます。この技術の背景には、大規模な多視点音声?視覚シーケンスデータセットの作成と、音声条件付き変換モデルの開発があり、これらのモデルは音声入力から直接唇や表情の特徴を抽出できます。

映像制作

46.1K

CHANGER

CHANGERは、革新的な工業レベルのヘッドブレンディング技術です。キーイング技術により、高忠実度のヘッドブレンディング効果を実現し、視覚効果(VFX)、デジタルヒューマン作成、バーチャルアバターなどの分野に特に適しています。背景統合と前景ブレンドを分離し、キーイングによって完璧な背景を生成し、ヘッド形状とロングヘアの強化(H^2強化)と前景予測的アテンション?トランスフォーマー(FPAT)モジュールを導入することで、様々な現実世界の状況への汎化能力を高めています。CHANGERの主な利点には、高忠実度、工業レベルの結果、そして現実世界の様々なケースへの幅広い適用性があります。

AI設計ツール

47.2K

高品質新製品

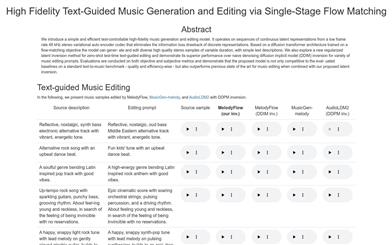

Melodyflow

MelodyFlowは、テキスト制御による高忠実度の音楽生成と編集を行うモデルです。連続潜在表現シーケンスを使用することで、離散表現による情報損失の問題を回避しています。拡散トランスフォーマーアーキテクチャに基づき、フローマッチング目標を用いた学習により、多様な高品質ステレオサンプルを生成?編集でき、テキストによる簡潔な指示が可能です。MelodyFlowは、ゼロショットテストにおけるテキストガイド編集のための新たな正規化潜在反転手法も提案しており、様々な音楽編集プロンプトにおいて優れた性能を示します。客観的?主観的指標による評価を通して、標準的なテキスト?ツー?ミュージックベンチマークにおいて、評価ベースラインと同等の品質と効率性、そして音楽編集においては従来最先端技術を凌駕する性能であることを実証しています。

音楽生成

48.0K

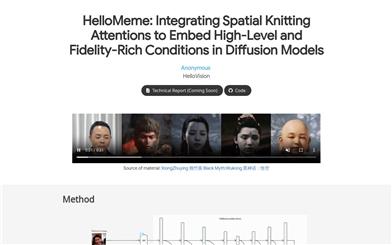

Hellomeme

HelloMemeは、空間織り込み注意力機構を統合した拡散モデルであり、高忠実度で豊富な条件を画像生成プロセスに組み込むことを目指しています。この技術は、駆動ビデオの各フレームの特徴を抽出し、それをHMControlModuleへの入力として使用することで、ビデオを生成します。さらにAnimatediffモジュールを最適化することで、生成されるビデオの連続性と忠実度を向上させています。さらに、HelloMemeはARKitによる顔のブレンドシェイプを用いた顔表情の制御、SD1.5ベースのLoraまたはCheckpointによるフレームのホットスワップアダプターをサポートしており、T2Iモデルの汎化能力に影響を与えることはありません。

AI画像生成

56.6K

高品質新製品

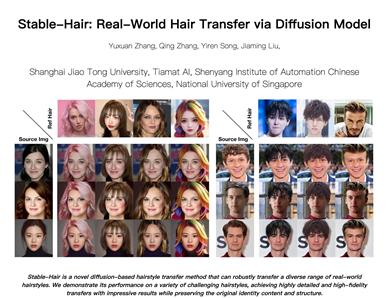

Stable Hair

Stable-Hairは、拡散モデルに基づく革新的なヘアスタイル転移手法です。現実世界の多様なヘアスタイルを、ユーザー提供の顔画像に堅牢に転移し、バーチャル試着を可能にします。複雑で多様なヘアスタイルの処理において優れた性能を発揮し、元のアイデンティティと構造を維持しながら、きわめて詳細で高忠実度の転移を実現します。

AI顔画像生成

55.8K

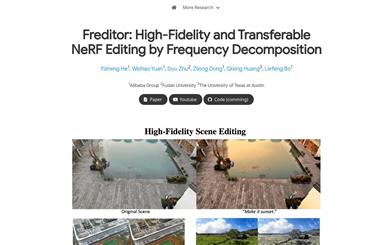

Freditor

Freditorは、周波数分解に基づいたNeRF編集手法です。高忠実度のNeRFシーン編集を実現し、他のシーンへの転移も可能です。この手法は、NeRFシーンを高周波数成分と低周波数成分に分割し、低周波数成分にスタイル転移を適用した後、高周波数成分の詳細を再統合することで、高忠実度の編集結果を生成します。Freditorは、推論過程において編集強度を制御することも可能です。実験により、この手法は、忠実度と転移可能性の両方において、既存のNeRF編集手法を上回ることが示されました。

AI画像生成

45.3K

高品質新製品

Musev

MuseVは、拡散モデルに基づいたバーチャル人物ビデオ生成フレームワークであり、無限長のビデオ生成に対応しています。革新的な視覚条件付き並列ノイズ除去方式を採用しています。Image2Video、Text2Image2Video、Video2Videoなどの機能を備えた、事前学習済みのバーチャル人物ビデオ生成モデルを提供しており、Stable Diffusionエコシステム(基本モデル、LoRA、ControlNetなど)と互換性があります。IPAdapter、ReferenceOnly、ReferenceNet、IPAdapterFaceIDなどの複数の参照画像技術に対応しています。MuseVの強みは、高忠実度で無限長のビデオを生成できる点であり、ビデオ生成分野をターゲットとしています。

AI動画生成

433.0K

Stability AI テキスト読み上げモデル

Stability AIの高忠実度テキスト読み上げモデルは、大規模データセットでトレーニングされた音声合成モデルへの自然言語によるガイドを提供することを目的としています。異なる話者、スタイル、録音条件をラベル付けすることで自然言語によるガイドを行い、この手法を45,000時間分のデータセットに適用して音声言語モデルをトレーニングします。さらに、本モデルはオーディオの高忠実度を向上させるシンプルな手法を提案しており、発見されたデータに完全に依存しているにもかかわらず、高い性能を示しています。

テキスト音声変換

84.2K

Sketch2nerf

Sketch2NeRFは、多視点スケッチをガイドとするテキストから3Dへの生成フレームワークです。これは、ニューラル放射場(NeRF)で表現される3Dシーンを、Stable DiffusionやControlNetなどの事前学習済み2D拡散モデルを用いて最適化します。本手法は、NeRFを効率的に最適化するための新規な同時生成?再構成手法も提案しています。収集した2種類の多視点スケッチデータセットを用いた実験評価により、高忠実度のテキストプロンプト下で、精緻なスケッチ制御による一貫性のある3Dコンテンツを合成できることを実証しました。広範な結果から、本手法はスケッチの類似性とテキストとの整合性において最先端の性能を達成していることが示されています。

AI画像生成

50.5K

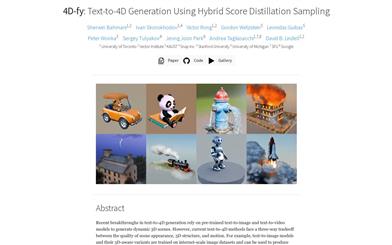

4D Fy

4D-fyは、混合分数蒸留サンプリング技術を用いたテキストから4Dシーンへの生成手法です。複数の事前学習済み拡散モデルの教師あり信号を組み合わせることで、高忠実度のテキストから4Dシーンへの生成を実現しています。本手法は、神経表現によって4D放射場をパラメータ化し、静的および動的多尺度ハッシュテーブル特徴量を使用し、ボリュームレンダリングによって表現から画像と動画をレンダリングします。混合分数蒸留サンプリングによって、まず3D認識テキストツーイメージモデル(3D-T2I)の勾配を用いて表現を最適化し、次にテキストツーイメージモデル(T2I)の勾配を組み合わせることで外観を改善し、最後にテキストツービデオモデル(T2V)の勾配を組み合わせることでシーンの動きを高めます。4D-fyは、魅力的な外観、3D構造、および動きを備えた4Dシーンを生成できます。

AI画像生成

54.4K

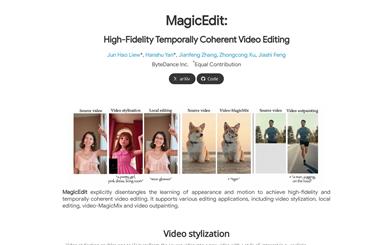

Magicedit

MagicEditは、高忠実度で時間軸の一貫性を保ったビデオ編集モデルです。外観と動きを明確に分離した学習により、ビデオのスタイル変更、部分編集、ビデオの混合、ビデオの拡張など、多様な編集用途に対応します。MagicEditはビデオ拡張タスクにも対応しており、再トレーニングなしで実現可能です。

AI動画編集

56.6K

おすすめAI製品

海外精選

Jules AI

Jules は、自動で煩雑なコーディングタスクを処理し、あなたに核心的なコーディングに時間をかけることを可能にする異步コーディングエージェントです。その主な強みは GitHub との統合で、Pull Request(PR) を自動化し、テストを実行し、クラウド仮想マシン上でコードを検証することで、開発効率を大幅に向上させています。Jules はさまざまな開発者に適しており、特に忙しいチームには効果的にプロジェクトとコードの品質を管理する支援を行います。

開発プログラミング

39.2K

Nocode

NoCode はプログラミング経験を必要としないプラットフォームで、ユーザーが自然言語でアイデアを表現し、迅速にアプリケーションを生成することが可能です。これにより、開発の障壁を下げ、より多くの人が自身のアイデアを実現できるようになります。このプラットフォームはリアルタイムプレビュー機能とワンクリックデプロイ機能を提供しており、技術的な知識がないユーザーにも非常に使いやすい設計となっています。

開発プラットフォーム

38.9K

Listenhub

ListenHub は軽量級の AI ポッドキャストジェネレーターであり、中国語と英語に対応しています。最先端の AI 技術を使用し、ユーザーが興味を持つポッドキャストコンテンツを迅速に生成できます。その主な利点には、自然な会話と超高品質な音声効果が含まれており、いつでもどこでも高品質な聴覚体験を楽しむことができます。ListenHub はコンテンツ生成速度を改善するだけでなく、モバイルデバイスにも対応しており、さまざまな場面で使いやすいです。情報取得の高効率なツールとして位置づけられており、幅広いリスナーのニーズに応えています。

AI

38.1K

中国語精選

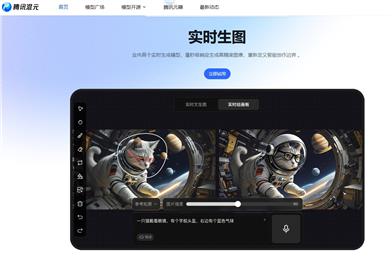

腾讯混元画像 2.0

腾讯混元画像 2.0 は腾讯が最新に発表したAI画像生成モデルで、生成スピードと画質が大幅に向上しました。超高圧縮倍率のエンコード?デコーダーと新しい拡散アーキテクチャを採用しており、画像生成速度はミリ秒級まで到達し、従来の時間のかかる生成を回避することが可能です。また、強化学習アルゴリズムと人間の美的知識の統合により、画像のリアリズムと詳細表現力を向上させ、デザイナー、クリエーターなどの専門ユーザーに適しています。

画像生成

38.1K

Openmemory MCP

OpenMemoryはオープンソースの個人向けメモリレイヤーで、大規模言語モデル(LLM)に私密でポータブルなメモリ管理を提供します。ユーザーはデータに対する完全な制御権を持ち、AIアプリケーションを作成する際も安全性を保つことができます。このプロジェクトはDocker、Python、Node.jsをサポートしており、開発者が個別化されたAI体験を行うのに適しています。また、個人情報を漏らすことなくAIを利用したいユーザーにお勧めします。

オープンソース

38.9K

Fastvlm

FastVLM は、視覚言語モデル向けに設計された効果的な視覚符号化モデルです。イノベーティブな FastViTHD ミックスドビジュアル符号化エンジンを使用することで、高解像度画像の符号化時間と出力されるトークンの数を削減し、モデルのスループットと精度を向上させました。FastVLM の主な位置付けは、開発者が強力な視覚言語処理機能を得られるように支援し、特に迅速なレスポンスが必要なモバイルデバイス上で優れたパフォーマンスを発揮します。

画像処理

38.1K

海外精選

ピカ

ピカは、ユーザーが自身の創造的なアイデアをアップロードすると、AIがそれに基づいた動画を自動生成する動画制作プラットフォームです。主な機能は、多様なアイデアからの動画生成、プロフェッショナルな動画効果、シンプルで使いやすい操作性です。無料トライアル方式を採用しており、クリエイターや動画愛好家をターゲットとしています。

映像制作

17.6M

中国語精選

Liblibai

LiblibAIは、中国をリードするAI創作プラットフォームです。強力なAI創作能力を提供し、クリエイターの創造性を支援します。プラットフォームは膨大な数の無料AI創作モデルを提供しており、ユーザーは検索してモデルを使用し、画像、テキスト、音声などの創作を行うことができます。また、ユーザーによる独自のAIモデルのトレーニングもサポートしています。幅広いクリエイターユーザーを対象としたプラットフォームとして、創作の機会を平等に提供し、クリエイティブ産業に貢献することで、誰もが創作の喜びを享受できるようにすることを目指しています。

AIモデル

6.9M