Aya Vision 32B

Aya Vision 32Bは、Cohere For AIによって開発された、320億個のパラメータを持つ高度なビジュアル言語モデルで、英語、中国語、アラビア語など23の言語をサポートしています。このモデルは、最新の多言語言語モデルAya Expanse 32BとSigLIP2ビジュアルエンコーダを組み合わせ、多様なモダリティアダプターによって視覚と言語の理解を統合しています。OCR、画像記述、視覚推論など、複雑な画像とテキストのタスクを処理できる、ビジュアル言語分野で優れたパフォーマンスを発揮します。このモデルの公開は、多様なモダリティ研究の普及を促進することを目的としており、そのオープンソースの重みは、世界中の研究者にとって強力なツールとなります。このモデルはCC-BY-NCライセンスに従い、Cohere For AIの適正使用ポリシーを遵守する必要があります。

AIモデル

46.4K

Alphamaze V0.2 1.5B

AlphaMazeは、大規模言語モデル(LLM)の視覚推論能力の向上に焦点を当てたプロジェクトです。テキストで記述された迷路タスクを通してモデルを訓練することで、空間構造の理解と計画能力を向上させます。この手法は、複雑な画像処理を回避するだけでなく、テキスト記述を通してモデルの空間理解能力を直接評価できます。主な利点は、モデルが空間問題をどのように解決しようとしているかを明らかにできる点であり、単に問題を解決できるかどうかだけでなく、その思考プロセスを垣間見ることができる点です。本モデルはオープンソースフレームワークに基づいており、言語モデルにおける視覚推論分野の研究開発を促進することを目的としています。

AIモデル

46.6K

Alphamaze

AlphaMazeは、視覚推論タスクの解決のために設計されたデコーダー言語モデルです。迷路解法タスクのトレーニングを通じて、言語モデルの視覚推論における可能性を示しています。このモデルは、15億パラメーターのQwenモデルをベースに構築されており、教師ありファインチューニング(SFT)と強化学習(RL)によってトレーニングされています。主な利点は、視覚タスクをテキスト形式に変換して推論できることであり、従来の言語モデルが空間理解において不足していた点を補っています。このモデルの開発背景は、特に段階的な推論が必要な状況において、AIの視覚タスクにおけるパフォーマンス向上にあります。現在、AlphaMazeは研究プロジェクトとして、商業化価格や市場ポジショニングは明確にされていません。

AIモデル

45.0K

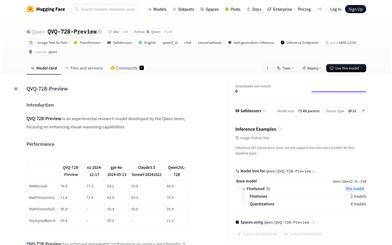

QVQ 72B Preview

QVQ-72B-PreviewはQwenチームが開発した実験的な研究モデルであり、視覚推論能力の強化に焦点を当てています。このモデルは、多様な分野の理解と推論において強力な能力を示し、特に数学的推論タスクにおいて著しい進歩を遂げています。視覚推論において進歩が見られる一方で、QVQはQwen2-VL-72Bを完全に代替するものではなく、複数ステップの視覚推論においては、画像内容への注意が徐々に低下し、幻覚が生じる可能性があります。さらに、QVQは基本的な認識タスクにおいて、Qwen2-VL-72Bよりも著しく優れた改善を示していません。

AIモデル

55.5K

Claude 3.5 Sonnet

Claude 3.5 Sonnetは、Anthropic社が開発したAIモデルであり、インテリジェンス、速度、コストの優れたバランスを実現しています。大学院レベルの推論能力、学部レベルの知識、そして熟練したプログラミングスキルにおいて、新たな業界基準を確立しています。特に、微妙なニュアンス、ユーモア、複雑な指示の理解に優れ、自然で親しみやすい口調で高品質なコンテンツを作成できます。さらに、視覚推論、チャート解釈、画像テキスト変換においても優れた性能を発揮し、小売、物流、金融サービスなどの業界に最適です。

AIモデル

119.8K

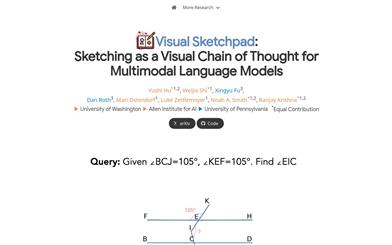

ビジュアル?スケッチパッド

ビジュアル?スケッチパッドは、マルチモーダル大規模言語モデル(LLM)に視覚的なスケッチパッドと描画ツールを提供するフレームワークです。このフレームワークにより、モデルは、自ら描いた視覚的な成果物を操作しながら、計画と推論を行うことができます。従来のテキストを推論ステップとして使用する手法とは異なり、ビジュアル?スケッチパッドでは、モデルは線、枠、マーカーなど、人間の描画方法により近い要素を使用して図を描くことができ、推論をより効果的に促進します。さらに、オブジェクト検出モデルによる境界ボックスの描画やセグメンテーションモデルによるマスクの描画など、専門的な視覚モデルを図面作成プロセスで使用することで、視覚認識と推論能力をさらに向上させることができます。

AIモデル

51.6K

高品質新製品

Cantor

Cantorは、マルチモーダル連鎖思考(CoT)フレームワークです。知覚意思決定アーキテクチャを通じて、視覚的コンテキストの取得と論理的推論を組み合わせ、複雑な視覚推論タスクを解決します。Cantorはまず意思決定ジェネレーターとして機能し、視覚入力を統合して画像と問題を分析することで、現実の状況とのより緊密な整合性を確保します。さらに、Cantorは大規模言語モデル(MLLM)の高度な認知機能を活用し、多面的な専門家として、より高次の情報を導き出し、CoT生成プロセスを強化します。Cantorは2つの複雑な視覚推論データセットで広範な実験を行い、微調整や事実上の根拠なしに、マルチモーダルCoTのパフォーマンスを大幅に向上させることで、提案されたフレームワークの有効性を証明しました。

AIモデル

52.2K

Cola

Colaは、言語モデル(LM)を使用して2つ以上の視覚言語モデル(VLM)の出力を統合する手法です。このモデル統合手法は、Cola(COordinative LAnguage model for visual reasoning)と呼ばれています。Colaは、LMファインチューニング(Cola-FTと呼ばれます)を行うと最適な効果を発揮します。また、ゼロショットまたは少ショットコンテキスト学習(Cola-Zeroと呼ばれます)においても有効です。性能向上に加え、ColaはVLMのエラーに対してもよりロバストです。Colaは、InstructBLIPなどの大規模マルチモーダルモデルを含む様々なVLMと、VQA v2、OK-VQA、A-OKVQA、e-SNLI-VE、VSR、CLEVR、GQAの7つのデータセットに適用可能であり、常に性能向上を示すことを実証しました。

AI画像検出識別

55.5K

おすすめAI製品

海外精選

Jules AI

Jules は、自動で煩雑なコーディングタスクを処理し、あなたに核心的なコーディングに時間をかけることを可能にする異步コーディングエージェントです。その主な強みは GitHub との統合で、Pull Request(PR) を自動化し、テストを実行し、クラウド仮想マシン上でコードを検証することで、開発効率を大幅に向上させています。Jules はさまざまな開発者に適しており、特に忙しいチームには効果的にプロジェクトとコードの品質を管理する支援を行います。

開発プログラミング

40.8K

Nocode

NoCode はプログラミング経験を必要としないプラットフォームで、ユーザーが自然言語でアイデアを表現し、迅速にアプリケーションを生成することが可能です。これにより、開発の障壁を下げ、より多くの人が自身のアイデアを実現できるようになります。このプラットフォームはリアルタイムプレビュー機能とワンクリックデプロイ機能を提供しており、技術的な知識がないユーザーにも非常に使いやすい設計となっています。

開発プラットフォーム

40.0K

Listenhub

ListenHub は軽量級の AI ポッドキャストジェネレーターであり、中国語と英語に対応しています。最先端の AI 技術を使用し、ユーザーが興味を持つポッドキャストコンテンツを迅速に生成できます。その主な利点には、自然な会話と超高品質な音声効果が含まれており、いつでもどこでも高品質な聴覚体験を楽しむことができます。ListenHub はコンテンツ生成速度を改善するだけでなく、モバイルデバイスにも対応しており、さまざまな場面で使いやすいです。情報取得の高効率なツールとして位置づけられており、幅広いリスナーのニーズに応えています。

AI

38.9K

中国語精選

腾讯混元画像 2.0

腾讯混元画像 2.0 は腾讯が最新に発表したAI画像生成モデルで、生成スピードと画質が大幅に向上しました。超高圧縮倍率のエンコード?デコーダーと新しい拡散アーキテクチャを採用しており、画像生成速度はミリ秒級まで到達し、従来の時間のかかる生成を回避することが可能です。また、強化学習アルゴリズムと人間の美的知識の統合により、画像のリアリズムと詳細表現力を向上させ、デザイナー、クリエーターなどの専門ユーザーに適しています。

画像生成

39.2K

Openmemory MCP

OpenMemoryはオープンソースの個人向けメモリレイヤーで、大規模言語モデル(LLM)に私密でポータブルなメモリ管理を提供します。ユーザーはデータに対する完全な制御権を持ち、AIアプリケーションを作成する際も安全性を保つことができます。このプロジェクトはDocker、Python、Node.jsをサポートしており、開発者が個別化されたAI体験を行うのに適しています。また、個人情報を漏らすことなくAIを利用したいユーザーにお勧めします。

オープンソース

40.3K

Fastvlm

FastVLM は、視覚言語モデル向けに設計された効果的な視覚符号化モデルです。イノベーティブな FastViTHD ミックスドビジュアル符号化エンジンを使用することで、高解像度画像の符号化時間と出力されるトークンの数を削減し、モデルのスループットと精度を向上させました。FastVLM の主な位置付けは、開発者が強力な視覚言語処理機能を得られるように支援し、特に迅速なレスポンスが必要なモバイルデバイス上で優れたパフォーマンスを発揮します。

画像処理

39.2K

海外精選

ピカ

ピカは、ユーザーが自身の創造的なアイデアをアップロードすると、AIがそれに基づいた動画を自動生成する動画制作プラットフォームです。主な機能は、多様なアイデアからの動画生成、プロフェッショナルな動画効果、シンプルで使いやすい操作性です。無料トライアル方式を採用しており、クリエイターや動画愛好家をターゲットとしています。

映像制作

17.6M

中国語精選

Liblibai

LiblibAIは、中国をリードするAI創作プラットフォームです。強力なAI創作能力を提供し、クリエイターの創造性を支援します。プラットフォームは膨大な数の無料AI創作モデルを提供しており、ユーザーは検索してモデルを使用し、画像、テキスト、音声などの創作を行うことができます。また、ユーザーによる独自のAIモデルのトレーニングもサポートしています。幅広いクリエイターユーザーを対象としたプラットフォームとして、創作の機会を平等に提供し、クリエイティブ産業に貢献することで、誰もが創作の喜びを享受できるようにすることを目指しています。

AIモデル

6.9M