Showui

紹介 :

ShowUIは、GUIエージェント向けに設計された軽量な視覚言語行動モデルです。視覚入力、言語理解、行動予測を組み合わせることで、コンピュータインターフェースがより自然な方法でユーザーの指示に応答することを可能にします。ShowUIの重要性は、特にGUI自動化や自然言語処理の分野において、人間とコンピュータのインタラクションの効率性と自然性を向上させる点にあります。このモデルはshowlab研究所によって開発され、現在Hugging Faceプラットフォームで公開されており、研究とアプリケーションに使用できます。

ターゲットユーザー :

開発者、研究者、そして自然言語処理やヒューマンコンピュータインタラクションに興味を持つ技術愛好家が対象ユーザーです。ShowUIは、視覚と言語に基づいたインタラクションシステムの開発と研究のための強力なツールを提供しており、自動テストやスマートアシスタントなど、複数の分野で活用できます。

使用シナリオ

- ShowUIモデルを使用して、フォームへの入力やボタンのクリックなどのWebページ操作を自動化します。

- ShowUIを使用して、画像認識と指示に基づくインターフェースナビゲーションを実行します。

- ShowUIをカスタムアプリケーションに統合して、より自然なユーザーエクスペリエンスを提供します。

製品特徴

- 視覚言語行動モデル:視覚入力、言語理解、行動予測を組み合わせます。

- GUI自動化:グラフィカルユーザーインターフェースの自動操作に使用します。

- モデルの訓練とデプロイ:Hugging Faceプラットフォームでのモデルの訓練とデプロイをサポートします。

- マルチモーダル入力:画像とテキストのマルチモーダル入力をサポートします。

- 行動予測:ユーザーの指示に対応するインターフェース操作を予測できます。

- インターフェース操作:クリック、入力、選択など、さまざまなインターフェース操作をサポートします。

- モデルのファインチューニング:特定のアプリケーションシナリオに合わせて、ファインチューニングコードと指示を提供します。

使用チュートリアル

1. 依存関係のインストール:pipを使用して、requirements.txtにリストされている依存関係をインストールします。

2. リポジトリのクローン作成:git cloneコマンドを使用してShowUIのコードリポジトリを複製します。

3. インターフェースの起動:app.pyを実行してShowUIのグラフィカルインターフェースを起動します。

4. モデルの読み込み:Qwen2VLForConditionalGenerationクラスを使用して、事前トレーニングされたShowUIモデルを読み込みます。

5. インターフェース操作:システムプロンプト、画像、クエリを含むmessagesリストを送信して、インターフェース操作を実行します。

6. 結果の表示:draw_point関数を使用して、クリック位置などの操作結果を画像にマークします。

7. モデルのファインチューニング:必要に応じて、モデルをファインチューニングして、特定のアプリケーションシナリオに適応させます。

おすすめAI製品

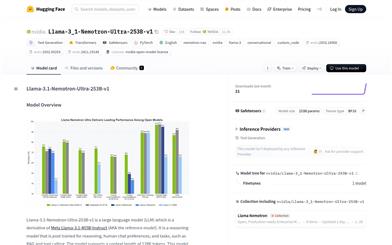

Deepmind Gemini

Geminiは、Google DeepMindが開発した次世代人工知能システムです。テキスト、画像、ビデオ、音声、コード間のシームレスな相互作用をサポートし、マルチモーダル推論を実行できます。言語理解、推論、数学、プログラミングなど、複数の分野において従来のシステムを凌駕し、現在までに開発された最も強力なAIシステムの一つとなっています。エッジコンピューティングからクラウドコンピューティングまで、様々なニーズに対応できる3つの異なる規模のバージョンがあります。Geminiは、クリエイティブデザイン、ライティングアシスタント、質問応答、コード生成など、幅広い分野で活用できます。

AIモデル

11.4M

中国語精選

Liblibai

LiblibAIは、中国をリードするAI創作プラットフォームです。強力なAI創作能力を提供し、クリエイターの創造性を支援します。プラットフォームは膨大な数の無料AI創作モデルを提供しており、ユーザーは検索してモデルを使用し、画像、テキスト、音声などの創作を行うことができます。また、ユーザーによる独自のAIモデルのトレーニングもサポートしています。幅広いクリエイターユーザーを対象としたプラットフォームとして、創作の機会を平等に提供し、クリエイティブ産業に貢献することで、誰もが創作の喜びを享受できるようにすることを目指しています。

AIモデル

6.9M