ID Animator

紹介 :

ID-Animatorは、追加のトレーニングなしで、単一の参照顔画像に基づいてパーソナライズされた動画を生成できる、ゼロショットの人物動画生成手法です。既存の拡散ベースの動画生成フレームワークを継承し、顔の適応器を追加して、人物のアイデンティティに関する埋め込みをエンコードします。この方法により、ID-Animatorは動画生成プロセスにおいて人物のアイデンティティの詳細を維持しながら、トレーニング効率を向上させることができます。

ターゲットユーザー :

["動画コンテンツで人物のアイデンティティを正確に維持する必要があるアプリケーションシナリオに適しています。","動画制作者やコンテンツクリエイターに、効率的なパーソナライズされた動画生成ソリューションを提供します。","ソーシャルメディアでパーソナライズされた動画を公開したいユーザーに、革新的な方法を提供します。","教育やトレーニング分野では、特定の人物の教育動画を生成して学習効果を向上させるために使用できます。","研究者には、人間の行動とアイデンティティ表現を研究するための新しいツールを提供します。"]

使用シナリオ

特定の外見と行動を持つ仮想キャラクターの動画を生成する

ソーシャルメディア広告向けにパーソナライズされたプロモーション動画を作成する

映画やゲーム制作において、特定のキャラクターに一致するアニメーション動画を生成する

パーソナライズされた教育動画の生成を行い、学習者の参加度と関心を高める

製品特徴

単一の参照顔画像に基づいたパーソナライズされた動画生成

人気の事前学習済みT2Vモデルとの高い互換性

効率的な顔の適応器モジュール設計による迅速なトレーニングと動画生成

アイデンティティ指向のデータセット構築プロセスによる、アイデンティティ情報抽出精度の向上

ランダム参照トレーニング方法による、無関係な特徴の影響軽減

基本的なプロンプトでの機能のデモ(特定の外見の人物の動画生成など)

アイデンティティの混合:埋め込み特徴を異なる比率で混合して動画を生成

制御網との組み合わせ:単一フレームまたは複数フレームの制御画像を提供して生成結果を精密に制御

スケッチから動画への変換:スケッチと参照画像を組み合わせて動画を生成

使用チュートリアル

ステップ1:参照顔画像を用意します。

ステップ2:事前学習済みのT2Vモデルをベースとして選択します。

ステップ3:アイデンティティ情報に適応する顔の適応器モジュールを設計?トレーニングします。

ステップ4:アイデンティティ指向のデータセット構築プロセスを通じて、アイデンティティ関連の埋め込みを抽出?学習します。

ステップ5:ランダム参照トレーニング方法を使用して、無関係な特徴の影響を軽減します。

ステップ6:必要に応じて制御画像やスケッチを提供して、動画生成の方向を指示します。

ステップ7:ID-Animatorモデルを実行して、パーソナライズされた動画コンテンツを生成します。

ステップ8:フィードバックに基づいてパラメーターを調整し、生成された動画の品質を最適化します。

おすすめAI製品

Sora

Soraは、大規模データで学習されたテキスト制御型ビデオ生成拡散モデルです。1分間の高解像度ビデオ生成が可能で、幅広い視覚データの種類と解像度に対応します。ビデオと画像の圧縮潜在空間で学習することで、時空間的位置パッチに分解し、スケーラブルなビデオ生成を実現しています。また、三次元の一貫性やインタラクションなど、物理世界とデジタル世界の挙動をある程度シミュレートできる能力を示しており、高性能シミュレータの開発に向けて、ビデオ生成モデルの大規模化が有望であることを示唆しています。

AI動画生成

17.0M

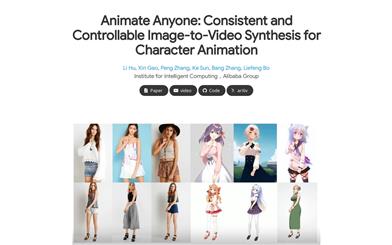

Animate Anyone

Animate Anyoneは、駆動信号から静止画像を基にキャラクタビデオを生成することを目指しています。拡散モデルの力を活用し、キャラクタアニメーション用に特化した新しいフレームワークを提案します。参照画像における複雑な外観特徴の一貫性を維持するため、空間的注意機構を用いて詳細な特徴を統合するReferenceNetを設計しました。制御可能性と連続性を確保するため、キャラクタの動作をガイドする効率的なポーズガイド機構を導入し、ビデオフレーム間の滑らかなクロスフェードを実現する効果的な時間モデリング手法を採用しています。トレーニングデータの拡張により、任意のキャラクタのアニメーション作成が可能になり、他の画像からビデオへの変換手法と比較して、キャラクタアニメーションにおいて優れた結果を得ています。さらに、ファッションビデオと人間のダンス合成のベンチマークにおいて最先端の結果を達成しました。

AI動画生成

11.4M