Qwen2.5 Coder 32B Instruct

简介 :

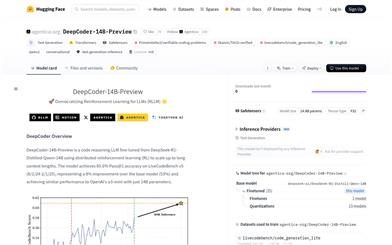

Qwen2.5-Coder是一系列专为代码生成设计的Qwen大型语言模型,包含0.5、1.5、3、7、14、32亿参数的六种主流模型尺寸,以满足不同开发者的需求。该模型在代码生成、代码推理和代码修复方面有显著提升,基于强大的Qwen2.5,训练令牌扩展到5.5万亿,包括源代码、文本代码基础、合成数据等。Qwen2.5-Coder-32B是目前最先进的开源代码生成大型语言模型,其编码能力与GPT-4o相匹配。它不仅增强了编码能力,还保持了在数学和通用能力方面的优势,并支持长达128K令牌的长上下文。

需求人群 :

目标受众为开发者、编程爱好者和软件工程师。Qwen2.5-Coder-32B-Instruct以其强大的代码生成和推理能力,特别适合需要处理复杂代码逻辑、进行代码优化和维护的大型软件开发团队,以及需要快速原型开发的初创企业和个人开发者。

使用场景

开发者使用Qwen2.5-Coder-32B-Instruct生成排序算法的代码。

软件工程师利用模型修复现有代码中的错误。

初创公司使用该模型快速开发新项目的原型。

产品特色

代码生成:显著提升代码生成能力,帮助开发者快速实现代码逻辑。

代码推理:增强代码推理能力,辅助开发者理解代码结构和逻辑。

代码修复:提供代码修复功能,帮助开发者定位并修复代码中的错误。

长上下文支持:支持长达128K令牌的长上下文,适合处理大型项目和复杂代码。

基于Transformers:采用transformers架构,包括RoPE、SwiGLU、RMSNorm和Attention QKV偏置等技术。

多参数配置:拥有32.5B参数,其中非嵌入参数为31.0B,64层,Q和KV的注意力头分别为40和8。

适用于实际应用:如代码代理等,不仅提升编码能力,还保持数学和通用能力。

使用教程

1. 访问Hugging Face网站并搜索Qwen2.5-Coder-32B-Instruct模型。

2. 根据页面提供的代码示例,导入必要的库和模块。

3. 加载模型和分词器,使用AutoModelForCausalLM和AutoTokenizer.from_pretrained方法。

4. 准备输入提示,如编写一个快速排序算法。

5. 使用tokenizer.apply_chat_template方法处理输入消息。

6. 将处理后的文本输入模型,生成模型输入。

7. 调用model.generate方法生成代码。

8. 使用tokenizer.batch_decode方法将生成的代码ID转换为文本形式。

精选AI产品推荐

Trae

Trae 是一款面向开发者的 AI 驱动的集成开发环境(IDE)。它通过智能代码补全、多模态交互以及对整个代码库的上下文分析等功能,帮助开发者更高效地编写代码。Trae 的主要优点在于其强大的 AI 能力,能够理解开发者的需求并提供精准的代码生成和修改建议。该产品目前提供免费版本,旨在帮助开发者减少重复性任务,专注于创造性工作,从而提升编程效率和生产力。

代码助手

1.8M

Fitten Code

Fitten Code是一个GPT驱动的代码生成和完成工具,支持多种语言:Python、Javascript、Typescript、Java等。它能够自动为您的代码补充缺失的部分,节省您宝贵的开发时间。基于AI大模型对代码进行语义级翻译,支持多种编程语言互译。同时,它能够根据您的代码自动生成相关注释,为您的代码提供清晰易懂的解释和文档。除此之外,它还拥有智能bug查找、解释代码、自动生成单元测试的功能,以及根据代码自动产生相应的测试用例等功能。

代码助手

993.6K