使用场景

视频博主使用CogVideo将脚本自动转换为视频,提高内容发布的效率。

教育机构利用CogVideo生成教学视频,辅助教学过程。

电影制作团队使用CogVideo进行初步的视频概念验证,加快创意实现过程。

产品特色

支持文本到视频的自动生成,将文本描述直接转换为视频内容。

提供多种模型版本,包括CogVideoX-2B和CogVideoX-5B,以适应不同的性能需求。

模型优化,能够在较低的GPU资源消耗下运行,使得在普通硬件上也能进行视频生成。

支持视频质量增强,通过VEnhancer技术提高视频的分辨率和质量。

提供详细的文档和示例代码,帮助用户快速上手和进行二次开发。

支持多语言输入,尽管主要使用英语,但可以通过翻译模型进行其他语言的文本输入。

模型开源,允许社区贡献和进一步的研究开发。

使用教程

访问CogVideo的GitHub页面,了解模型的基本信息和安装要求。

根据指导文档安装必要的软件依赖,如Python环境和深度学习库。

下载并配置CogVideo模型,可以选择适合自己硬件的模型版本。

准备文本输入,确保文本描述与所需视频内容相匹配。

运行模型,输入文本描述,模型将自动生成视频。

根据需要,使用VEnhancer等工具对生成的视频进行质量增强。

分享或进一步编辑生成的视频,以满足特定的使用需求。

精选AI产品推荐

Sora

Sora是一个基于大规模训练的文本控制视频生成扩散模型。它能够生成长达1分钟的高清视频,涵盖广泛的视觉数据类型和分辨率。Sora通过在视频和图像的压缩潜在空间中训练,将其分解为时空位置补丁,实现了可扩展的视频生成。Sora还展现出一些模拟物理世界和数字世界的能力,如三维一致性和交互,揭示了继续扩大视频生成模型规模来发展高能力模拟器的前景。

AI视频生成

17.2M

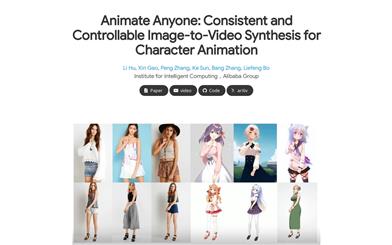

Animate Anyone

Animate Anyone旨在通过驱动信号从静态图像生成角色视频。我们利用扩散模型的力量,提出了一个专为角色动画量身定制的新框架。为了保持参考图像中复杂外观特征的一致性,我们设计了ReferenceNet来通过空间注意力合并详细特征。为了确保可控性和连续性,我们引入了一个高效的姿势指导器来指导角色的动作,并采用了一种有效的时间建模方法,以确保视频帧之间的平滑跨帧过渡。通过扩展训练数据,我们的方法可以为任意角色制作动画,与其他图像到视频方法相比,在角色动画方面取得了出色的结果。此外,我们在时尚视频和人类舞蹈合成的基准上评估了我们的方法,取得了最先进的结果。

AI视频生成

11.8M