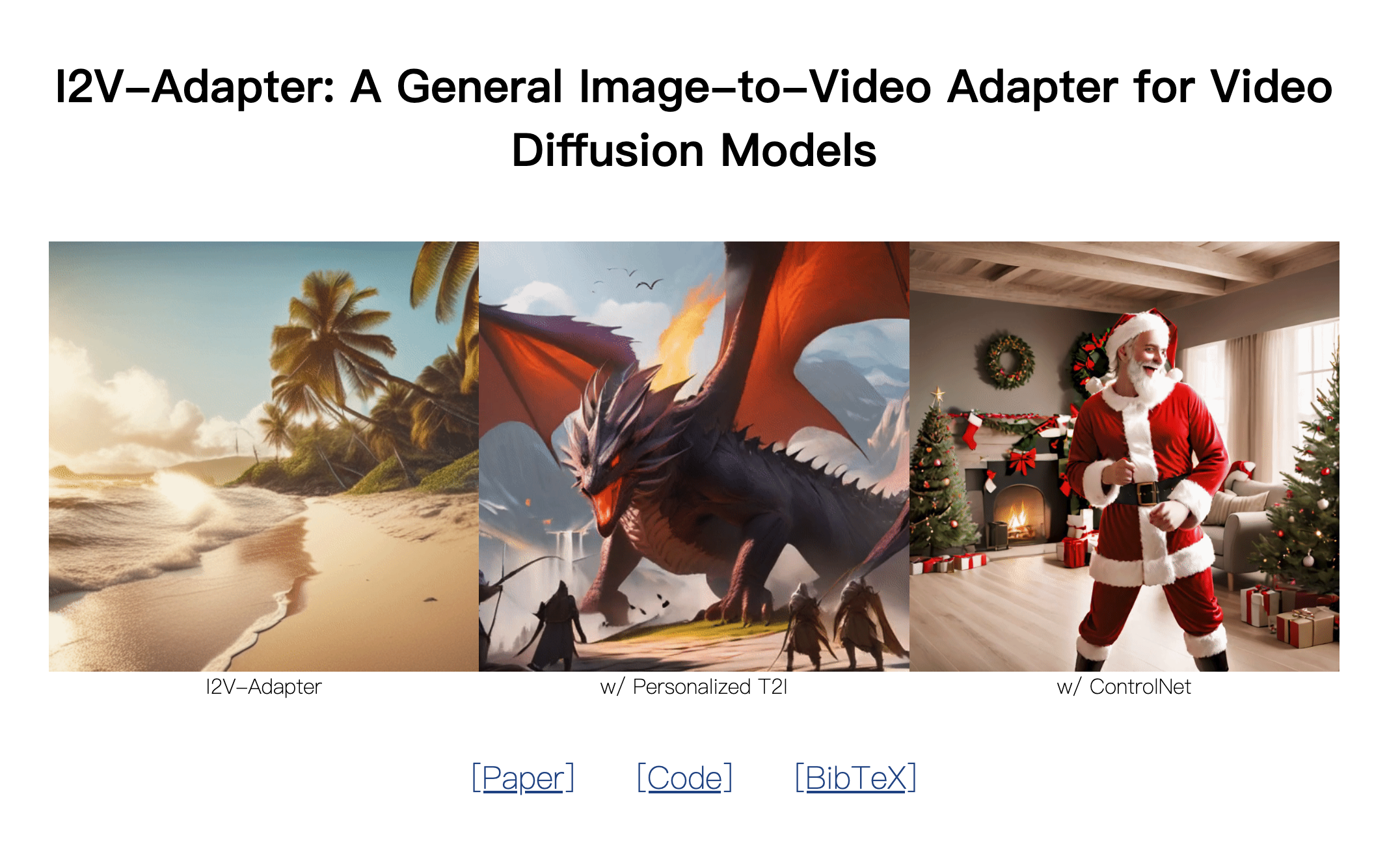

I2V Adapter

简介 :

I2V-Adapter旨在将静态图像转换为动态、逼真的视频序列,同时保持原始图像的保真度。它使用轻量级适配器模块并行处理带噪声的视频帧和输入图像。此模块充当桥梁,有效地将输入连接到模型的自注意力机制,保持空间细节,无需更改T2I模型的结构。I2V-Adapter参数少于传统模型,并确保与现有的T2I模型和控制工具兼容。实验结果表明,I2V-Adapter能够生成高质量的视频输出,这对于AI驱动的视频生成,尤其是创意应用领域,具有重大意义。

需求人群 :

适用于需要将图像转换为视频序列的开发者和创意专业人士。

使用场景

开发者使用I2V-Adapter将静态图像转换为动态视频内容。

动画师利用I2V-Adapter为动画片段创建逼真的视频序列。

研究人员在AI驱动的视频生成领域探索新技术。

产品特色

将静态图像转换为动态视频序列

保持原始图像保真度

使用轻量级适配器模块并行处理图像和视频

保持模型的自注意力机制和空间细节

与现有T2I模型和控制工具兼容

精选AI产品推荐

Sora

Sora是一个基于大规模训练的文本控制视频生成扩散模型。它能够生成长达1分钟的高清视频,涵盖广泛的视觉数据类型和分辨率。Sora通过在视频和图像的压缩潜在空间中训练,将其分解为时空位置补丁,实现了可扩展的视频生成。Sora还展现出一些模拟物理世界和数字世界的能力,如三维一致性和交互,揭示了继续扩大视频生成模型规模来发展高能力模拟器的前景。

AI视频生成

17.2M

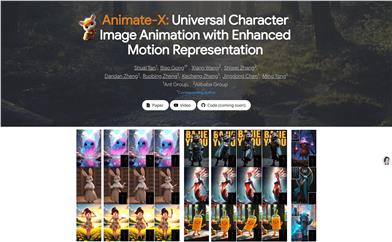

Animate Anyone

Animate Anyone旨在通过驱动信号从静态图像生成角色视频。我们利用扩散模型的力量,提出了一个专为角色动画量身定制的新框架。为了保持参考图像中复杂外观特征的一致性,我们设计了ReferenceNet来通过空间注意力合并详细特征。为了确保可控性和连续性,我们引入了一个高效的姿势指导器来指导角色的动作,并采用了一种有效的时间建模方法,以确保视频帧之间的平滑跨帧过渡。通过扩展训练数据,我们的方法可以为任意角色制作动画,与其他图像到视频方法相比,在角色动画方面取得了出色的结果。此外,我们在时尚视频和人类舞蹈合成的基准上评估了我们的方法,取得了最先进的结果。

AI视频生成

11.8M