使用場景

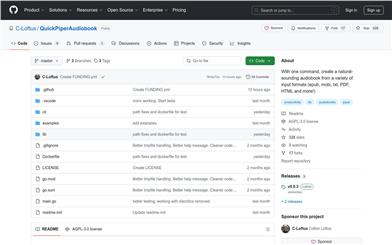

使用AudioLCM生成特定文本的朗讀音頻,用於有聲書或播客。

將歷史人物的演講稿轉化為逼真的語音,用於教育或展覽。

為視頻遊戲或動畫角色生成定製的語音,增強角色的個性和表現力。

產品特色

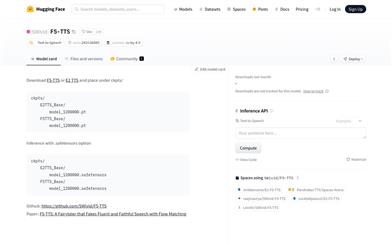

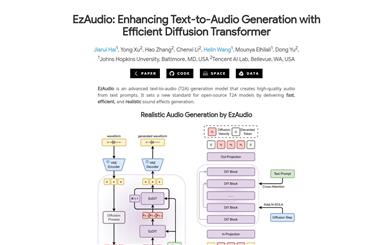

支持從文本到音頻的高保真度生成。

提供了預訓練模型,方便用戶快速開始使用。

允許用戶下載權重,以支持自定義數據集。

提供了詳細的訓練和推理代碼,方便用戶學習和二次開發。

能夠處理mel頻譜圖的生成,為音頻合成提供必要的中間表示。

支持變分自編碼器和擴散模型的訓練,以生成高質量的音頻。

提供了評估工具,可以計算FD, FAD, IS, KL等音頻質量指標。

使用教程

克隆AudioLCM的GitHub倉庫到本地機器。

根據README中的說明,準備NVIDIA GPU和CUDA cuDNN環境。

下載所需的數據集權重,並按照指導準備數據集信息。

運行mel頻譜圖生成腳本,為音頻合成準備中間表示。

訓練變分自編碼器(VAE),以學習文本和音頻之間的潛在映射。

使用訓練好的VAE模型,訓練擴散模型以生成高質量的音頻。

使用評估工具對生成的音頻進行質量評估,如計算FD, FAD等指標。

根據個人需求,對模型進行微調和優化,以適應特定的應用場景。

精選AI產品推薦

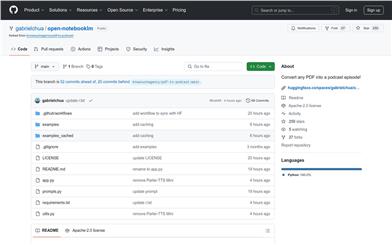

Openai TTS

OpenAI TTS提供文本到語音的API,基於他們的TTS模型。它帶有6種內置語音,可用於朗讀博客文章、在多種語言中生成口語音頻以及使用流式傳輸即時音頻輸出。用戶可以通過控制模型名稱、文本和語音選擇來生成音頻文件,並且支持多種音頻輸出格式。

AI文本轉語音

906.7K

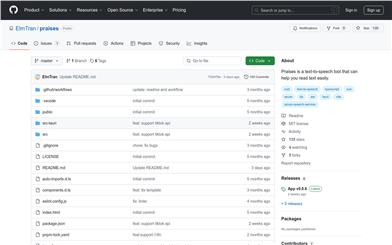

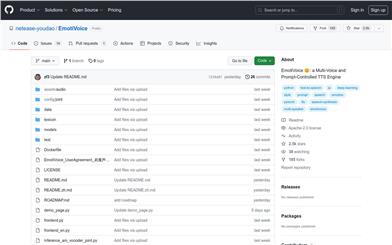

Emotivoice

EmotiVoice是一個功能強大、現代化的開源文本到語音引擎。它支持英語和中文,並擁有超過2000種不同的語音。最顯著的特點是情感合成,可以讓你創造具有各種情感的語音,包括快樂、興奮、悲傷、憤怒等。

EmotiVoice提供了一個易於使用的網頁界面,還提供了用於批量生成結果的腳本界面。

主要功能點包括:

1. 支持英語和中文

2. 擁有超過2000種不同的語音

3. 提供情感合成功能

價格:免費

定位:面向開發者和研究人員。

AI文本轉語音

329.8K